|

|

| (не показано 48 промежуточных версий этого же участника) |

| Строка 1: |

Строка 1: |

| − | | + | Основные авторы описания: [[Участник:Sveta|Закирова С.В.]] |

| − | Общая схема описания алгоритмов имеет следующий вид:

| + | Поиск равновесия в дуополии Штакельберга |

| | | | |

| | == Свойства и структура алгоритмов == | | == Свойства и структура алгоритмов == |

| − | Свойства алгоритмов никак не зависят от вычислительных систем, и с этой точки зрения данная часть AlgoWiki имеет безусловную собственную ценность. Описание алгоритма делается один раз, после чего многократно используется для его реализации в различных программно-аппаратных средах. Несмотря на то, что в данной части мы рассматриваем лишь машинно-независимые свойства алгоритмов, соображения, важные на этапе реализации, или же ссылки на соответствующие пункты [[#ЧАСТЬ. Программная реализация алгоритмов|части II AlgoWiki]], здесь также вполне уместны.

| |

| | | | |

| | === Общее описание алгоритма === | | === Общее описание алгоритма === |

| Строка 9: |

Строка 8: |

| | | | |

| | === Математическое описание алгоритма === | | === Математическое описание алгоритма === |

| − | Есть множество стратегий первого игрока <math> X </math> и мноожество стратегий <math> Y </math> второго игрока. | + | Есть множество стратегий первого игрока <math> X </math> и множество стратегий <math> Y </math> второго игрока. |

| − | Первым ходит игрок, называемый лидером, его стратегия <math> x \in X </math>. Второй игрок, называемый подчиненным, ходит стратегией <math> y \in Y </math>. У каждого игрока есть своя функция выигрыша. Для лидера это функция <math> H(x,y) </math>. | + | Первым ходит игрок, называемый лидером, его стратегия <math> x \in X </math>. Второй игрок, называемый подчиненным, ходит стратегией <math> y \in Y </math>. У каждого игрока есть своя функция выигрыша. Для лидера это функция <math> H(x,y) </math>. |

| − | Для подчиненного <math> g(x,y) </math>. Оба хотят максимизировать свой выигрыш, при условии лояльности(лояльность, это когда при условии одинакового выигрыша для второго, он максимизирует выигрыш первого) второго игрока по отношении к первому. Набор стратегий <math> (x^*,y^*) </math> называется равновесием Штакельберга, если <math> y^* = R(x^*) </math> есть наилучший ответ подчиненного на стратегию лидера, которая находится как решение задачи <math> H(x^*, y^*) = max H(x,R(x)) </math> | + | Для подчиненного <math> G(x,y) </math>. Оба хотят максимизировать свой выигрыш, при условии лояльности(лояльность, это когда при условии одинакового выигрыша для второго, он максимизирует выигрыш первого) второго игрока по отношении к первому. Набор стратегий <math> (x^*,y^*) </math> называется равновесием Штакельберга<ref> Васин А.А., Морозов В.В. "Введение в теорию игр с приложениями в экономике"(учебное пособие). - М.: 2003. - 278 с. Pages 131-132 </ref>, если <math> y^* = R(x^*) </math> есть наилучший ответ подчиненного на стратегию лидера, которая находится как решение задачи <math> H(x^*, y^*) = max H(x,R(x)) </math> (максимум берется по всем стратегиям <math>x</math> из <math>X</math>) |

| | | | |

| | === Вычислительное ядро алгоритма === | | === Вычислительное ядро алгоритма === |

| − | Для каждой стратегии первого, найдем множество наилучших ответов второго, благожелательных к первому. По всем найденым ответам второго, максимизируем выигрыш первого.

| + | Вычислительным ядром данного алгоритма является поиск максимума в строке. Таким образом мы находим наилучший ответ второго игрока. |

| − | | |

| | | | |

| | === Макроструктура алгоритма === | | === Макроструктура алгоритма === |

| − | Если алгоритм использует в качестве составных частей другие алгоритмы, то это указывается в данном разделе. Если в дальнейшем имеет смысл описывать алгоритм не в максимально детализированном виде (т.е. на уровне арифметических операций), а давать только его макроструктуру, то здесь описывается структура и состав макроопераций. Если в других разделах описания данного алгоритма в рамках AlgoWiki используются введенные здесь макрооперации, то здесь даются пояснения, необходимые для однозначной интерпретации материала. Типичные варианты макроопераций, часто встречающиеся на практике: нахождение суммы элементов вектора, скалярное произведение векторов, умножение матрицы на вектор, решение системы линейных уравнений малого порядка, сортировка, вычисление значения функции в некоторой точке, поиск минимального значения в массиве, транспонирование матрицы, вычисление обратной матрицы и многие другие.

| + | Как уже сказано в пункте выше, основнуая составляющая часть алгоритма это поиск максимума в строке. |

| | | | |

| − | Описание макроструктуры очень полезно на практике. Параллельная структура алгоритмов может быть хорошо видна именно на макроуровне, в то время как максимально детальное отображение всех операций может сильно усложнить картину. Аналогичные аргументы касаются и многих вопросов реализации, и если для алгоритма эффективнее и/или технологичнее оставаться на макроуровне, оформив макровершину, например, в виде отдельной процедуры, то это и нужно отразить в данном разделе.

| + | Алгоритм можно представить как многократное повторение(по количеству строк) поиска максимума в строках первой матрицы. После этого поиск максимума по элементам второй матрицы, индексы которых уже были найдены в первой итерации. |

| − | Выбор макроопераций не однозначен, причем, выделяя различные макрооперации, можно делать акценты на различных свойствах алгоритмов. С этой точки зрения, в описании одного алгоритма может быть представлено несколько вариантов его макроструктуры, дающих дополнительную информацию о его структуре. На практике, подобные альтернативные формы представления макроструктуры алгоритма могут оказаться исключительно полезными для его эффективной реализации на различных вычислительных платформах.

| |

| | | | |

| | === Схема реализации последовательного алгоритма === | | === Схема реализации последовательного алгоритма === |

| − | Здесь описываются все шаги, которые нужно выполнить при последовательной реализации данного алгоритма. В некотором смысле, данный раздел является избыточным, поскольку математическое описание уже содержит всю необходимую информацию. Однако он, несомненно, полезен: схема реализации алгоритма выписывается явно, помогая однозначной интерпретации приводимых далее оценок и свойств.

| |

| | | | |

| − | Описание может быть выполнено в виде блок-схемы, последовательности математических формул, обращений к описанию других алгоритмов, фрагмента кода на Фортране, Си или другом языке программирования, фрагмента кода на псевдокоде и т.п. Главное - это сделать схему реализации последовательного алгоритма полностью понятной. Совершенно не обязательно все шаги детализировать до элементарных операций, отдельные шаги могут соответствовать макрооперациям, отвечающим другим алгоритмам.

| + | <source lang="C++"> |

| | + | #include <vector> |

| | + | #include <cstdlib> |

| | + | #include <ctime> |

| | + | using namespace std; |

| | + | |

| | + | |

| | + | |

| | + | int main(int argc, char *argv[]) |

| | + | { |

| | + | //считиываем m и n |

| | + | int n = strtol(argv[1], NULL, 10); |

| | + | int m = strtol(argv[2], NULL, 10); |

| | + | |

| | + | //создаем матрицы G и H |

| | + | vector<vector<double>> H(n, vector<double>(m)); |

| | + | vector<vector<double>> G(n, vector<double>(m)); |

| | + | |

| | + | //инициализируем матрицы G и H |

| | + | srand(time(NULL)); |

| | + | for(int i = 0; i < n; ++i) { |

| | + | for(int j = 0; j < m; ++j) { |

| | + | H[i][j] = rand(); |

| | + | G[i][j] = rand(); |

| | + | } |

| | + | } |

| | + | |

| | + | //ищем максимум в G благожелательно к лидеру на каждую его стратегию |

| | + | vector<int> ind(n); |

| | + | for(int i = 0; i < n; ++i){ |

| | + | double max_in_line = H[i][0]; |

| | + | int ind_max = 0; |

| | + | for(int j = 0; j < m; ++j){ |

| | + | if (G[i][j] > max_in_line) { |

| | + | max_in_line = G[i][j]; |

| | + | ind_max = j; |

| | + | } else if (G[i][j] == max_in_line) { |

| | + | if (H[i][j] > H[i][ind_max]) { |

| | + | ind_max = j; |

| | + | max_in_line = G[i][j]; |

| | + | } |

| | + | } |

| | + | } |

| | + | ind[i] = ind_max; |

| | + | } |

| | + | |

| | + | //ищем с учетом ответа второго наилучшую тратегию для лидера |

| | + | int str_h = 0; |

| | + | for(int i = 0; i < n; ++i) { |

| | + | if (H[i][ind[i]] > H[str_h][ind[str_h]]) { |

| | + | str_h = i; |

| | + | } |

| | + | } |

| | + | |

| | | | |

| − | Описание схемы реализации вполне может содержать и словесные пояснения, отражающие какие-либо тонкие нюансы самого алгоритма или его реализации. Уже в данном разделе можно сказать про возможный компромисс между объемом требуемой оперативной памяти и временем работы алгоритма, между используемыми структурами данных и степенью доступного параллелизма. В частности, часто возникает ситуация, когда можно ввести дополнительные временные массивы или же отказаться от использования специальных компактных схем хранения данных, увеличивая степень доступного параллелизма.

| + | } |

| | + | |

| | + | </source> |

| | | | |

| | === Последовательная сложность алгоритма === | | === Последовательная сложность алгоритма === |

| − | В данном разделе описания свойств алгоритма приводится оценка его [[глоссарий#Последовательная сложность|''последовательной сложности'']], т.е. числа операций, которые нужно выполнить при последовательном исполнении алгоритма (в соответствии с [[#Описание схемы реализации последовательного алгоритма|п.1.5]]). Для разных алгоритмов понятие операции, в терминах которой оценивается его сложность, может существенно различаться. Это могут быть операции для работы с вещественными числами, целыми числами, поразрядные операции, обращения в память, обновления элементов массива, элементарные функции, макрооперации и другие. В LU-разложении преобладают арифметические операции над вещественными числами, а для транспонирования матриц важны лишь обращения к памяти: это и должно найти отражение в описании.

| + | Для первой части - поиска наилучших стратегий для воторого потребуется <math> m * n </math> операций сравенения. |

| | | | |

| − | Если выбор конкретного типа операций для оценки сложности алгоритма не очевиден, то нужно привести обоснование возможных вариантов. В некоторых случаях можно приводить оценку не всего алгоритма, а лишь его вычислительного ядра: в таком случае это нужно отметить, сославшись [[#Общее описание алгоритма|на п.1.1]].

| + | Для второй части - поиска наилучших стратегий первого потребуется <math> n </math> операций сравнения. |

| | | | |

| − | Например, сложность алгоритма суммирования элементов вектора сдваиванием равна <math>n-1</math>. Сложность быстрого преобразования Фурье (базовый алгоритм Кули-Тьюки) для векторов с длиной, равной степени двойки – <math>n\log_2n</math> операций комплексного сложения и <math>(n\log_2n)/2</math> операций комплексного умножения. Сложность базового алгоритма разложения Холецкого (точечный вариант для плотной симметричной и положительно-определенной матрицы) это <math>n</math> вычислений квадратного корня, <math>n(n-1)/2</math> операций деления, по <math>(n^3-n)/6</math> операций умножения и сложения (вычитания).

| + | Таким образом результирующая сложность алгоритма - <math> О(n * m) </math> операций. |

| | | | |

| | === Информационный граф === | | === Информационный граф === |

| − | Это очень важный раздел описания. Именно здесь можно показать (увидеть) как устроена параллельная структура алгоритма, для чего приводится описание и изображение его информационного графа ([[глоссарий#Граф алгоритма|''графа алгоритма'']] <ref name="VVVVVV">Воеводин В.В., Воеводин Вл.В. Параллельные вычисления. - СПб.: БХВ-Петербург, 2002. - 608 с. </ref>). Для рисунков с изображением графа будут составлены рекомендации по их формированию, чтобы все информационные графы, внесенные в энциклопедию, можно было бы воспринимать и интерпретировать одинаково. Дополнительно можно привести полное параметрическое описание графа в терминах покрывающих функций <ref name="VVVVVV" />.

| + | Опишем граф алгоритма в виде рисунка. |

| | + | [[File:Информационный граф РШ.png]] |

| | | | |

| − | Интересных вариантов для отражения информационной структуры алгоритмов много. Для каких-то алгоритмов нужно показать максимально подробную структуру, а иногда важнее макроструктура. Много информации несут разного рода проекции информационного графа, выделяя его регулярные составляющие и одновременно скрывая несущественные детали. Иногда оказывается полезным показать последовательность в изменении графа при изменении значений внешних переменных (например, размеров матриц): мы часто ожидаем "подобное" изменение информационного графа, но это изменение не всегда очевидно на практике.

| + | Круглые элеменеты графа - элементы матрицы G. Под max, имеется в виду функция поиска максимума в строке (причем с уметом благожелательности). |

| | | | |

| − | В целом, задача изображения графа алгоритма весьма нетривиальна. Начнем с того, что это потенциально бесконечный граф, число вершин и дуг которого определяется значениями внешних переменных, а они могут быть весьма и весьма велики. В такой ситуации, как правило, спасают упомянутые выше соображения подобия, делающие графы для разных значений внешних переменных "похожими": почти всегда достаточно привести лишь один граф небольшого размера, добавив, что графы для остальных значений будут устроены "точно также". На практике, увы, не всегда все так просто, и здесь нужно быть аккуратным.

| + | max2 - опять же функция поиска максимума для первого, исходя из ответов второго. |

| | + | |

| | + | === Ресурс параллелизма алгоритма === |

| | + | Каждую строку можно обрабатывать отдельным процессором. Таким образом каждый процессор бежит по строке и ищет там максимум (с условием благосклонности к лидеру). После этого процессоры синхронизируются и мы ищем максимум из уже найденых значений, таким образом мы получаем наибольший выигрыш для лидера, после чего находим все равновесия по Штакельбергу. |

| | + | |

| | + | Параллельная сложность: <math>О(m)</math>, где <math>m</math> число столбцов а нашей матрице. |

| | + | |

| | + | === Входные и выходные данные алгоритма === |

| | + | Входными данными являются пара матриц <math> H(x,y) </math>, <math> G(x,y) </math> одинакового размера <math>n * m </math> (стратегии обоих игроков). Выходные данные это множество пар чисел <math> (x^*,y^*) </math>, где каждая из пар является равновесием по Штакельбергу в нашей дуаполии. |

| | + | |

| | + | == Программная реализация алгоритма == |

| | | | |

| − | Далее, граф алгоритма - это потенциально многомерный объект. Наиболее естественная система координат для размещения вершин и дуг информационного графа опирается на структуру вложенности циклов в реализации алгоритма. Если глубина вложенности циклов не превышает трех, то и граф размещается в привычном трехмерном пространстве, однако для более сложных циклических конструкций с глубиной вложенности 4 и больше необходимы специальные методы представления и изображения графов.

| + | === Особенности реализации последовательного алгоритма === |

| | | | |

| − | В данном разделе AlgoWiki могут использоваться многие интересные возможности, которые еще подлежат обсуждению: возможность повернуть граф при его отображении на экране компьютера для выбора наиболее удобного угла обзора, разметка вершин по типу соответствующим им операций, отражение [[глоссарий#Ярусно-параллельная форма графа алгоритма|''ярусно-параллельной формы графа'']] и другие. Но в любом случае нужно не забывать главную задачу данного раздела - показать информационную структуру алгоритма так, чтобы стали понятны все его ключевые особенности, особенности параллельной структуры, особенности множеств дуг, участки регулярности и, напротив, участки с недерминированной структурой, зависящей от входных данных.

| + | === Локальность данных и вычислений === |

| | | | |

| − | На рис.1 показана информационная структура алгоритма умножения матриц, на рис.2 - информационная структура одного из вариантов алгоритма решения систем линейных алгебраических уравнений с блочно-двухдиагональной матрицей.

| + | === Возможные способы и особенности параллельной реализации алгоритма === |

| | | | |

| − | [[file:Fig1.svg|thumb|center|300px|Рис.1. Информационная структура алгоритма умножения матриц]]

| + | === Масштабируемость алгоритма и его реализации === |

| − | [[file:Fig2.svg|thumb|center|300px|Рис.2. Информационная структура одного из вариантов алгоритма решения систем линейных алгебраических уравнений с блочно-двухдиагональной матрицей]]

| + | Проведём исследование масштабируемости параллельной реализации алгоритма. Набор и границы значений изменяемых параметров запуска реализации алгоритма: |

| | | | |

| − | === Ресурс параллелизма алгоритма ===

| + | число процессоров [1,2 4, 8 : 32] со значениями квадрата целого числа; |

| − | Здесь приводится оценка [[глоссарий#Параллельная сложность|''параллельной сложности'']] алгоритма: числа шагов, за которое можно выполнить данный алгоритм в предположении доступности неограниченного числа необходимых процессоров (функциональных устройств, вычислительных узлов, ядер и т.п.). Параллельная сложность алгоритма понимается как высота канонической ярусно-параллельной формы <ref name="VVVVVV" />. Необходимо указать, в терминах каких операций дается оценка. Необходимо описать сбалансированность параллельных шагов по числу и типу операций, что определяется шириной ярусов канонической ярусно-параллельной формы и составом операций на ярусах.

| |

| | | | |

| − | Параллелизм в алгоритме часто имеет естественную иерархическую структуру. Этот факт очень полезен на практике, и его необходимо отразить в описании. Как правило, подобная иерархическая структура параллелизма хорошо отражается в последовательной реализации алгоритма через циклический профиль результирующей программы (конечно же, с учетом графа вызовов), поэтому циклический профиль ([[#Описание схемы реализации последовательного алгоритма|п.1.5]]) вполне может быть использован и для отражения ресурса параллелизма.

| + | размер матрицы(для тестов бралась квадратная матрица) [1000:10000] с шагом 1000. |

| | | | |

| − | Для описания ресурса параллелизма алгоритма (ресурса параллелизма информационного графа) необходимо указать ключевые параллельные ветви в терминах [[глоссарий#Конечный параллелизм|''конечного'']] и [[глоссарий#Массовый параллелизм|''массового'']] параллелизма. Далеко не всегда ресурс параллелизма выражается просто, например, через [[глоссарий#Кооодинатный параллелизм|''координатный параллелизм'']] или, что то же самое, через независимость итераций некоторых циклов (да-да-да, циклы - это понятие, возникающее лишь на этапе реализации, но здесь все так связано… В данном случае, координатный параллелизм означает, что информационно независимые вершины лежат на гиперплоскостях, перпендикулярных одной из координатных осей). С этой точки зрения, не менее важен и ресурс [[глоссарий#Скошенный параллелизм|''скошенного параллелизма'']]. В отличие от координатного параллелизма, скошенный параллелизм намного сложнее использовать на практике, но знать о нем необходимо, поскольку иногда других вариантов и не остается: нужно оценить потенциал алгоритма, и лишь после этого, взвесив все альтернативы, принимать решение о конкретной параллельной реализации. Хорошей иллюстрацией может служить алгоритм, структура которого показана на рис.2: координатного параллелизма нет, но есть параллелизм скошенный, использование которого снижает сложность алгоритма с <math>n\times m</math> в последовательном случае до <math>(n+m-1)</math> в параллельном варианте.

| + | На следующем рисунке приведен график производительности выбранной реализации алгоритма в зависимости от изменяемых параметров запуска. |

| | + | [[Файл:График_РШ.png |thumb|center|700px|Рис.1. График маштабируемости]] |

| | | | |

| − | Рассмотрим алгоритмы, последовательная сложность которых уже оценивалась в [[#Последовательная сложность алгоритма|п.1.6]]. Параллельная сложность алгоритма суммирования элементов вектора сдваиванием равна <math>\log_2n</math>, причем число операций на каждом ярусе убывает с <math>n/2</math> до <math>1</math>. Параллельная сложность быстрого преобразования Фурье (базовый алгоритм Кули-Тьюки) для векторов с длиной, равной степени двойки - <math>\log_2n</math>. Параллельная сложность базового алгоритма разложения Холецкого (точечный вариант для плотной симметричной и положительно-определенной матрицы) это <math>n</math> шагов для вычислений квадратного корня, <math>(n-1)</math> шагов для операций деления и <math>(n-1)</math> шагов для операций умножения и сложения.

| + | '''сведения о программно-аппаратной среде''' |

| | | | |

| − | === Входные и выходные данные алгоритма ===

| + | компьютер: суперкомпьютор Ломоносов |

| − | В данном разделе необходимо описать объем, структуру, особенности и свойства входных и выходных данных алгоритма: векторы, матрицы, скаляры, множества, плотные или разреженные структуры данных, их объем. Полезны предположения относительно диапазона значений или структуры, например, диагональное преобладание в структуре входных матриц, соотношение между размером матриц по отдельным размерностям, большое число матриц очень малой размерности, близость каких-то значений к машинному нулю, характер разреженности матриц и другие.

| |

| | | | |

| − | === Свойства алгоритма ===

| + | компилятор с использованными опциями оптимизации: mpicxx версии openmpi/1.8.4-gcc |

| − | Описываются прочие свойства алгоритма, на которые имеет смысл обратить внимание на этапе реализации. Как и ранее, никакой привязки к конкретной программно-аппаратной платформе не предполагается, однако вопросы реализации в проекте AlgoWiki всегда превалируют, и необходимость обсуждения каких-либо свойств алгоритмов определяется именно этим.

| |

| | | | |

| − | Весьма полезным является ''соотношение последовательной и параллельной сложности'' алгоритма. Оба понятия мы рассматривали ранее, но здесь делается акцент на том выигрыше, который теоретически может дать параллельная реализация алгоритма. Не менее важно описать и те сложности, которые могут возникнуть в процессе получения параллельной версии алгоритма.

| + | библиотеки: #include <mpi.h>, #include <iostream>, #include <cstdlib>, #include <ctime>, #include <vector> |

| | | | |

| − | [[глоссарий#Вычислительная мощность|''Вычислительная мощность'']] алгоритма равна отношению числа операций к суммарному объему входных и выходных данных. Она показывает, сколько операций приходится на единицу переданных данных. Несмотря на простоту данного понятия, это значение исключительно полезно на практике: чем выше вычислительная мощность, тем меньше накладных расходов вызывает перемещение данных для их обработки, например, на сопроцессоре, ускорителе или другом узле кластера. Например, вычислительная мощность скалярного произведения двух векторов равна всего лишь <math>1</math>, а вычислительная мощность алгоритма умножения двух квадратных матриц равна <math>2n/3</math>.

| + | '''выводы о масштабируемости''' |

| | | | |

| − | Вопрос первостепенной важности на последующем этапе реализации - это [[глоссарий#Устойчивость|''устойчивость'']] алгоритма. Все, что касается различных сторон этого понятия, в частности, оценки устойчивости, должно быть описано в данном разделе.

| + | Мы получили ожидаемые результаты(в целом), что производительность увеличивается с |

| | + | увеличеснием количества процессоров и уменьшается с увеличеннием количества строк. |

| | + | Это можно объяснить тем, что выбранный алгоритм очень хорошо распараллеливается, а |

| | + | «общение» процессоров почти не требуется (это важно так как эта процедура достаточно |

| | + | ресурсозатратна). |

| | | | |

| − | ''Сбалансированность'' вычислительного процесса можно рассматривать с разных сторон. Здесь и сбалансированность типов операций, в частности, арифметических операций между собой (сложение, умножение, деление) или же арифметических операций по отношению к операциям обращения к памяти (чтение/запись). Здесь и сбалансированность операций между параллельными ветвями алгоритма. С одной стороны, балансировка нагрузки является необходимым условием эффективной реализации алгоритма. Вместе с этим, это очень непростая задача, и в описании должно быть отмечено явно, насколько алгоритм обладает этой особенностью. Если обеспечение сбалансированности не очевидно, желательно описать возможные пути решения этой задачи.

| + | === Динамические характеристики и эффективность реализации алгоритма === |

| | | | |

| − | На практике важна [[глоссарий#Детерминированность|''детерминированность алгоритмов'']], под которой будем понимать постоянство структуры вычислительного процесса. С этой точки зрения, классическое умножение плотных матриц является детерминированным алгоритмом, поскольку его структура при фиксированном размере матриц никак не зависит от элементов входных матриц. Умножение разреженных матриц, когда матрица хранятся в одном из специальных форматов, свойством детерминированности уже не обладает: его свойства, например, степень локальности данных зависит от структуры разреженности входных матриц. Итерационный алгоритм с выходом по точности также не является детерминированным: число итераций, а значит и число операций, меняется в зависимости от входных данных. В этом же ряду стоит использование датчиков случайных чисел, меняющих вычислительный процесс для различных запусков программы. Причина выделения свойства детерминированности понятна: работать с детерминированным алгоритмом проще, поскольку один раз найденная структура и будет определять качество его реализации. Если детерминированность нарушается, то это должно быть здесь описано вместе с описанием того, как недетерминированность влияет на структуру вычислительного процесса.

| + | === Выводы для классов архитектур === |

| | | | |

| − | Серьезной причиной недетерминированности работы параллельных программ является изменение порядка выполнения ассоциативных операций. Типичный пример - это использование глобальных MPI-операций на множестве параллельных процессов, например, суммирование элементов распределенного массива. Система времени исполнения MPI сама выбирает порядок выполнения операций, предполагая выполнение свойства ассоциативности, из-за чего ошибки округления меняются от запуска программы к запуску, внося изменения в конечный результат ее работы. Это очень серьезная проблема, которая сегодня встречается часто на системах с массовым параллелизмом и определяет отсутствие повторяемости результатов работы параллельных программ. Данная особенность характерна для [[#ЧАСТЬ. Программная реализация алгоритмов|второй части AlgoWiki]], посвященной реализации алгоритмов, но вопрос очень важный, и соответствующие соображения, по возможности, должны быть отмечены и здесь.

| |

| | | | |

| − | Заметим, что, в некоторых случаях, недетерминированность в структуре алгоритмов можно "убрать" введением соответствующих макроопераций, после чего структура становится не только детерминированной, но и более понятной для восприятия. Подобное действие также следует отразить в данном разделе.

| |

| | | | |

| − | [[глоссарий#Степень исхода|''Степень исхода вершины информационного графа'']] показывает, в скольких операциях ее результат будет использоваться в качестве аргумента. Если степень исхода вершины велика, то на этапе реализации алгоритма нужно позаботиться об эффективном доступе к результату ее работы. В этом смысле, особый интерес представляют рассылки данных, когда результат выполнения одной операции используется во многих других вершинах графа, причем число таких вершин растет с увеличением значения внешних переменных.

| + | === Существующие реализации алгоритма === |

| | + | Написанная мной, текущая реализация алгоритма: |

| | + | <source lang="C++"> |

| | | | |

| − | ''"Длинные" дуги в информационном графе'' <ref name="VVVVVV" /> говорят о потенциальных сложностях с размещением данных в иерархии памяти компьютера на этапе выполнения программы. С одной стороны, длина дуги зависит от выбора конкретной системы координат, в которой расположены вершины графа, а потому в другой системе координат они попросту могут исчезнуть (но не появится ли одновременно других длинных дуг?). А с другой стороны, вне зависимости от системы координат их присутствие может быть сигналом о необходимости длительного хранения данных на определенном уровне иерархии, что накладывает дополнительные ограничения на эффективность реализации алгоритма. Одной из причин возникновения длинных дуг являются рассылки скалярных величин по всем итерациям какого-либо цикла: в таком виде длинные дуги не вызывают каких-либо серьезных проблем на практике.

| + | #include <mpi.h> |

| | + | #include <iostream> |

| | + | #include <cstdlib> |

| | + | #include <ctime> |

| | + | #include <vector> |

| | | | |

| − | Для проектирования специализированных процессоров или реализации алгоритма на ПЛИС представляют интерес ''компактные укладки информационного графа'' <ref name="VVVVVV" />, которые также имеет смысл привести в данном разделе.

| + | using namespace std; |

| | | | |

| − | == Программная реализация алгоритма ==

| |

| − | Вторая часть описания алгоритмов в рамках AlgoWiki рассматривает все составные части процесса их реализации. Рассматривается как последовательная реализация алгоритма, так и параллельная. Описывается взаимосвязь свойств программ, реализующих алгоритм, и особенностей архитектуры компьютера, на которой они выполняются. Исследуется работа с памятью, локальность данных и вычислений, описывается масштабируемость и эффективность параллельных программ, производительность компьютеров, достигаемая на данной программе. Обсуждаются особенности реализации для разных классов архитектур компьютеров, приводятся ссылки на реализации в существующих библиотеках.

| |

| | | | |

| − | === Особенности реализации последовательного алгоритма ===

| |

| − | Здесь описываются особенности и варианты реализации алгоритма в виде последовательной программы, которые влияют на [[глоссарий#Эффективность реализации|''эффективность ее выполнения'']]. В частности, в данном разделе имеет смысл ''сказать о существовании блочных вариантов реализации алгоритма'', дополнительно описав потенциальные преимущества или недостатки, сопровождающие такую реализацию. Важный вопрос - это ''возможные варианты организации работы с данными'', варианты структур данных, наборов временных массивов и другие подобные вопросы. Для различных вариантов реализации следует оценить доступный ресурс параллелизма и объем требуемой памяти.

| |

| | | | |

| − | Важным нюансом является ''описание необходимой разрядности выполнения операций алгоритма'' (точности). На практике часто нет никакой необходимости выполнять все арифметические операции над вещественными числами с двойной точностью, т.к. это не влияет ни на устойчивость алгоритма, ни на точность получаемого результата. В таком случае, если значительную часть операций можно выполнять над типом float, и лишь в некоторых фрагментах необходим переход к типу double, это обязательно нужно отметить. Это прямое указание не только на правильную реализацию с точки зрения устойчивости по отношению к ошибкам округления, но и на более эффективную.

| + | int main(int argc, char * argv[]) |

| | + | { |

| | | | |

| − | Опираясь на информацию из [[#Описание ресурса параллелизма алгоритма|п.1.8]] (описание ресурса параллелизма алгоритма), при описании последовательной версии стоит сказать про возможности [[глоссарий#Эквивалентное преобразование|''эквивалентного преобразования программ'']], реализующих данных алгоритм. В дальнейшем, это даст возможность простого использования доступного параллелизма или же просто покажет, как использовать присущий алгоритму параллелизм на практике. Например, параллелизм на уровне итераций самого внутреннего цикла обычно используется для векторизации. Однако, в некоторых случаях этот параллелизм можно поднять "вверх" по структуре вложенности объемлющих циклов, что делает возможной и эффективную реализацию данного алгоритма на многоядерных SMP-компьютерах.

| + | int comm_sz, my_rank; |

| | + | MPI_Init(&argc, &argv); |

| | + | MPI_Comm comm = MPI_COMM_WORLD; |

| | + | MPI_Comm_size(comm, &comm_sz); |

| | + | MPI_Comm_rank(comm, &my_rank); |

| | | | |

| − | С этой же точки зрения, в данном разделе весьма полезны соображения по реализации алгоритма на различных параллельных вычислительных платформах. Высокопроизводительные кластеры, многоядерные узлы, возможности для векторизации или использования ускорителей - особенности этих архитектур не только опираются на разные свойства алгоритмов, но и по-разному должны быть выражены в программах, что также желательно описать в данном разделе.

| + | //считываем размеры матрицы |

| | + | int n,m; |

| | + | if (my_rank == 0) { |

| | + | n = strtol(argv[1], NULL, 10); |

| | + | m = strtol(argv[2], NULL, 10); |

| | + | } |

| | | | |

| − | === Локальность данных и вычислений ===

| + | MPI_Bcast(&m, 1, MPI_INT, 0, comm); |

| − | Вопросы локальности данных и вычислений не часто изучаются на практике, но именно локальность определяет эффективность выполнения программ на современных вычислительных платформах <ref>Воеводин В.В., Воеводин Вад.В. Спасительная локальность суперкомпьютеров //Открытые системы. - 2013. - № 9. - С. 12-15.</ref><ref>Воеводин Вад.В., Швец П. Метод покрытий для оценки локальности использования данных в программах // Вестник УГАТУ. — 2014. — Т. 18, № 1(62). — С. 224–229.</ref>. В данном разделе приводятся оценки степени [[глоссарий#Локальность использования данных|''локальности данных'']] и [[глоссарий#Локальность вычислений|вычислений]] в программе, причем рассматривается как [[глоссарий#Временная локальность|''временна́я'']], так и [[глоссарий#Пространственная локальность|''пространственная'']] локальность. Отмечаются позитивные и негативные факты, связанные с локальностью, какие ситуации и при каких условиях могут возникать. Исследуется, как меняется локальность при переходе от последовательной реализации к параллельной. Выделяются ключевые шаблоны взаимодействия программы, реализующей описываемый алгоритм, с памятью. Отмечается возможная взаимосвязь между используемыми конструкциями языков программирования и степенью локальности, которыми обладают результирующие программы.

| + | MPI_Bcast(&n, 1, MPI_INT, 0, comm); |

| | | | |

| − | Отдельно приводятся профили взаимодействия с памятью для вычислительных ядер и ключевых фрагментов. Если из-за большого числа обращений по общему профилю сложно понять реальную специфику взаимодействия программ с памятью, то проводится последовательная детализация и приводится серия профилей более мелкого масштаба.

| + | //делим матрицу |

| | + | int local_n = n / comm_sz; |

| | + | int rem = n % comm_sz; |

| | + | if(my_rank < rem) { |

| | + | local_n++; |

| | + | } |

| | | | |

| − | На рис.3 и рис.4 показаны профили обращения в память для программ, реализующих разложение Холецкого и быстрое преобразование Фурье, по которым хорошо видна разница свойств локальности у данных алгоритмов.

| + | vector<vector<double> > G(local_n, vector<double> (m, -5)) , H(local_n, vector<double> (m, -5)); |

| | | | |

| − | [[file:Cholesky_locality1.jpg|thumb|center|700px|Рис.3 Реализация метода Холецкого. Общий профиль обращений в память]] | + | //генирируем мартицу |

| − | [[file:fft 1.PNG|thumb|center|700px|Рис.4 Нерекурсивная реализация БПФ для степеней двойки. Общий профиль обращений в память]] | + | srand(time(NULL)); |

| | + | for(int i = 0; i < local_n; ++i) { |

| | + | for(int j = 0; j < m; ++j) { |

| | + | H[i][j] = rand(); |

| | + | G[i][j] = rand(); |

| | + | } |

| | + | } |

| | | | |

| − | === Возможные способы и особенности параллельной реализации алгоритма === | + | double s_time = 0; |

| − | Раздел довольно обширный, в котором должны быть описаны основные факты и положения, формирующие параллельную программу. К их числу можно отнести:

| + | if (rank == 0) { |

| − | * представленный иерархически ресурс параллелизма, опирающийся на структуру циклических конструкций и на граф вызовов программы;

| + | s_time = MPI_Wtime(); |

| − | * комбинацию (иерархию) массового параллелизма и параллелизма конечного;

| + | } |

| − | * возможные способы распределения операций между процессами/нитями;

| |

| − | * возможные способы распределения данных;

| |

| − | * оценку количества операций, объёма и числа пересылок данных (как общего числа, так и в пересчёте на каждый параллельный процесс);

| |

| | | | |

| − | и другие.

| + | //ищем максимум в G благожелательно к лидеру на каждую его стратегию |

| | + | vector<int> local_ind(local_n); |

| | + | vector<double> local_max(local_n); |

| | + | for(int i = 0; i < local_n; ++i){ |

| | + | double max_in_line = G[i][0]; |

| | + | int ind_max = 0; |

| | + | for(int j = 0; j < m; ++j){ |

| | + | if (G[i][j] > max_in_line) { |

| | + | max_in_line = G[i][j]; |

| | + | ind_max = j; |

| | + | } else if (G[i][j] == max_in_line) { |

| | + | if (H[i][j] > H[i][ind_max]) { |

| | + | ind_max = j; |

| | + | max_in_line = G[i][j]; |

| | + | } |

| | + | } |

| | + | } |

| | + | local_ind[i] = ind_max; |

| | + | local_max[i] = H[i][ind_max]; |

| | + | } |

| | | | |

| − | В этом же разделе должны быть даны рекомендации или сделаны комментарии относительно реализации алгоритма с помощью различных технологий параллельного программирования: MPI, OpenMP, CUDA или использования директив векторизации.

| + | //ищем с учетом ответа второго наилучшую тратегию для лидера |

| | + | double max_in_proc = local_max[0]; |

| | + | for (int i = 0; i < local_n; ++i) { |

| | + | if(max_in_proc < local_max[i]) { |

| | + | max_in_proc = local_max[i]; |

| | + | } |

| | + | } |

| | | | |

| − | === Масштабируемость алгоритма и его реализации ===

| + | double res_max; |

| − | Задача данного раздела - показать пределы [[глоссарий#Масштабируемость|''масштабируемости'']] алгоритма на различных платформах. Очень важный раздел. Нужно выделить, описать и оценить влияние точек барьерной синхронизации, глобальных операций, операций сборки/разборки данных, привести оценки или провести исследование [[глоссарий#Сильная масштабируемость|''сильной'']] и [[глоссарий#Слабая масштабируемость|''слабой'']] масштабируемости алгоритма и его реализаций.

| + | |

| | + | MPI_Allreduce(&max_in_proc, &res_max, 1, MPI_DOUBLE, MPI_MAX, comm); |

| | | | |

| − | Масштабируемость алгоритма определяет свойства самого алгоритма безотносительно конкретных особенностей используемого компьютера. Она показывает, насколько параллельные свойства алгоритма позволяют использовать возможности растущего числа процессорных элементов. Масштабируемость параллельных программ определяется как относительно конкретного компьютера, так и относительно используемой технологии программирования, и в этом случае она показывает, насколько может вырасти реальная производительность данного компьютера на данной программе, записанной с помощью данной технологии программирования, при использовании бóльших вычислительных ресурсов (ядер, процессоров, вычислительных узлов).

| + | //ищем все равновесия по Штакельбергу |

| | + | for (int i = 0; i < local_n; ++i) { |

| | + | if(res_max == local_max[i]) { |

| | + | //i, max_ind[i] равновесие по Штакельбергу |

| | + | } |

| | + | } |

| | | | |

| − | Ключевой момент данного раздела заключается в том, чтобы показать ''реальные параметры масштабируемости программы'' для данного алгоритма на различных вычислительных платформах в зависимости от числа процессоров и размера задачи <ref>Антонов А.С., Теплов А.М. О практической сложности понятия масштабируемости параллельных программ// Высокопроизводительные параллельные вычисления на кластерных системах (HPC 2014): Материалы XIV Международной конференции -Пермь: Издательство ПНИПУ, 2014. С. 20-27.</ref>. При этом важно подобрать такое соотношение между числом процессоров и размером задачи, чтобы отразить все характерные точки в поведении параллельной программы, в частности, достижение максимальной производительности, а также тонкие эффекты, возникающие, например, из-за блочной структуры алгоритма или иерархии памяти.

| + | //выводим время |

| | + | double f_time = 0; |

| | + | if (rank == 0) { |

| | + | f_time = MPI_Wtime(); |

| | + | cout << n << ' ' << f_time - s_time << endl; |

| | + | } |

| | | | |

| − | На рис.5. показана масштабируемость классического алгоритма умножения плотных матриц в зависимости от числа процессоров и размера задачи. На графике хорошо видны области с большей производительностью, отвечающие уровням кэш-памяти.

| |

| − | [[file:Масштабируемость перемножения матриц производительность.png|thumb|center|700px|Рис.5 Масштабируемость классического алгоритма умножения плотных матриц в зависимости от числа процессоров и размера задачи]]

| |

| | | | |

| − | === Динамические характеристики и эффективность реализации алгоритма ===

| |

| − | Это объемный раздел AlgoWiki, поскольку оценка эффективности реализации алгоритма требует комплексного подхода <ref>Никитенко Д.А. Комплексный анализ производительности суперкомпьютерных систем, основанный на данных системного мониторинга // Вычислительные методы и программирование. 2014. 15. 85–97.</ref>, предполагающего аккуратный анализ всех этапов от архитектуры компьютера до самого алгоритма. Основная задача данного раздела заключается в том, чтобы оценить степень эффективности параллельных программ, реализующих данный алгоритм на различных платформах, в зависимости от числа процессоров и размера задачи. Эффективность в данном разделе понимается широко: это и [[глоссарий#Эффективность распараллеливания|''эффективность распараллеливания'']] программы, это и [[глоссарий#Эффективность реализации|''эффективность реализации'']] программ по отношению к пиковым показателям работы вычислительных систем.

| |

| | | | |

| − | Помимо собственно показателей эффективности, нужно описать и все основные причины, из-за которых эффективность работы параллельной программы на конкретной вычислительной платформе не удается сделать выше. Это не самая простая задача, поскольку на данный момент нет общепринятой методики и соответствующего инструментария, с помощью которых подобный анализ можно было бы провести. Требуется оценить и описать эффективность работы с памятью (особенности профиля взаимодействия программы с памятью), эффективность использования заложенного в алгоритм ресурса параллелизма, эффективность использования коммуникационной сети (особенности коммуникационного профиля), эффективность операций ввода/вывода и т.п. Иногда достаточно интегральных характеристик по работе программы, в некоторых случаях полезно показать данные мониторинга нижнего уровня, например, по загрузке процессора, кэш-промахам, интенсивности использования сети Infiniband и т.п. Хорошее представление о работе параллельной MPI-программы дают данные трассировки, полученные, например, с помощью системы Scalasca.

| |

| | | | |

| − | === Выводы для классов архитектур ===

| |

| − | В данный раздел должны быть включены рекомендации по реализации алгоритма для разных классов архитектур. Если архитектура какого-либо компьютера или платформы обладает специфическими особенностями, влияющими на эффективность реализации, то это здесь нужно отметить.

| |

| | | | |

| − | На практике это сделать можно по-разному: либо все свести в один текущий раздел, либо же соответствующие факты сразу включать в предшествующие разделы, где они обсуждаются и необходимы по смыслу. В некоторых случаях, имеет смысл делать отдельные варианты всей [[#ЧАСТЬ. Программная реализация алгоритмов|части II]] AlgoWiki применительно к отдельным классам архитектур, оставляя общей машинно-независимую [[#ЧАСТЬ. Свойства и структура алгоритмов|часть I]]. В любом случае, важно указать и позитивные, и негативные факты по отношению к конкретным классам. Можно говорить о возможных вариантах оптимизации или даже о "трюках" в написании программ, ориентированных на целевые классы архитектур.

| + | MPI_Finalize(); |

| | | | |

| − | === Существующие реализации алгоритма ===

| + | } |

| − | Для многих пар алгоритм+компьютер уже созданы хорошие реализации, которыми можно и нужно пользоваться на практике. Данный раздел предназначен для того, чтобы дать ссылки на основные существующие последовательные и параллельные реализации алгоритма, доступные для использования уже сейчас. Указывается, является ли реализация коммерческой или свободной, под какой лицензией распространяется, приводится местоположение дистрибутива и имеющихся описаний. Если есть информация об особенностях, достоинствах и/или недостатках различных реализаций, то это также нужно здесь указать. Хорошими примерами реализации многих алгоритмов являются MKL, ScaLAPACK, PETSc, FFTW, ATLAS, Magma и другие подобные библиотеки.

| + | </source> |

| | | | |

| | == Литература == | | == Литература == |

| − | <references />

| |

| − |

| |

| − | [[en:Description of algorithm properties and structure]]

| |

Основные авторы описания: Закирова С.В.

Поиск равновесия в дуополии Штакельберга

1 Свойства и структура алгоритмов

1.1 Общее описание алгоритма

Модель дуополии Штакельберга является развитием модели дуополии Курно. Если в модели Курно считается, что участники рынка не прогнозируют отклика конкурента на собственные действия, то в модели Штакельберга один участник рынка не прогнозирует поведения конкурента, а второй учитывает поведение первого, зная, что конкурент не ответит на его действия. Другими словами, второй участник рынка знает, что первый участник рынка ведет себя в соответствии с моделью Курно. [1]

1.2 Математическое описание алгоритма

Есть множество стратегий первого игрока [math] X [/math] и множество стратегий [math] Y [/math] второго игрока.

Первым ходит игрок, называемый лидером, его стратегия [math] x \in X [/math]. Второй игрок, называемый подчиненным, ходит стратегией [math] y \in Y [/math]. У каждого игрока есть своя функция выигрыша. Для лидера это функция [math] H(x,y) [/math].

Для подчиненного [math] G(x,y) [/math]. Оба хотят максимизировать свой выигрыш, при условии лояльности(лояльность, это когда при условии одинакового выигрыша для второго, он максимизирует выигрыш первого) второго игрока по отношении к первому. Набор стратегий [math] (x^*,y^*) [/math] называется равновесием Штакельберга[2], если [math] y^* = R(x^*) [/math] есть наилучший ответ подчиненного на стратегию лидера, которая находится как решение задачи [math] H(x^*, y^*) = max H(x,R(x)) [/math] (максимум берется по всем стратегиям [math]x[/math] из [math]X[/math])

1.3 Вычислительное ядро алгоритма

Вычислительным ядром данного алгоритма является поиск максимума в строке. Таким образом мы находим наилучший ответ второго игрока.

1.4 Макроструктура алгоритма

Как уже сказано в пункте выше, основнуая составляющая часть алгоритма это поиск максимума в строке.

Алгоритм можно представить как многократное повторение(по количеству строк) поиска максимума в строках первой матрицы. После этого поиск максимума по элементам второй матрицы, индексы которых уже были найдены в первой итерации.

1.5 Схема реализации последовательного алгоритма

#include <vector>

#include <cstdlib>

#include <ctime>

using namespace std;

int main(int argc, char *argv[])

{

//считиываем m и n

int n = strtol(argv[1], NULL, 10);

int m = strtol(argv[2], NULL, 10);

//создаем матрицы G и H

vector<vector<double>> H(n, vector<double>(m));

vector<vector<double>> G(n, vector<double>(m));

//инициализируем матрицы G и H

srand(time(NULL));

for(int i = 0; i < n; ++i) {

for(int j = 0; j < m; ++j) {

H[i][j] = rand();

G[i][j] = rand();

}

}

//ищем максимум в G благожелательно к лидеру на каждую его стратегию

vector<int> ind(n);

for(int i = 0; i < n; ++i){

double max_in_line = H[i][0];

int ind_max = 0;

for(int j = 0; j < m; ++j){

if (G[i][j] > max_in_line) {

max_in_line = G[i][j];

ind_max = j;

} else if (G[i][j] == max_in_line) {

if (H[i][j] > H[i][ind_max]) {

ind_max = j;

max_in_line = G[i][j];

}

}

}

ind[i] = ind_max;

}

//ищем с учетом ответа второго наилучшую тратегию для лидера

int str_h = 0;

for(int i = 0; i < n; ++i) {

if (H[i][ind[i]] > H[str_h][ind[str_h]]) {

str_h = i;

}

}

}

1.6 Последовательная сложность алгоритма

Для первой части - поиска наилучших стратегий для воторого потребуется [math] m * n [/math] операций сравенения.

Для второй части - поиска наилучших стратегий первого потребуется [math] n [/math] операций сравнения.

Таким образом результирующая сложность алгоритма - [math] О(n * m) [/math] операций.

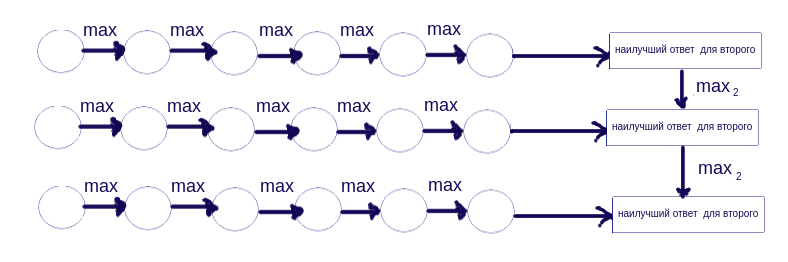

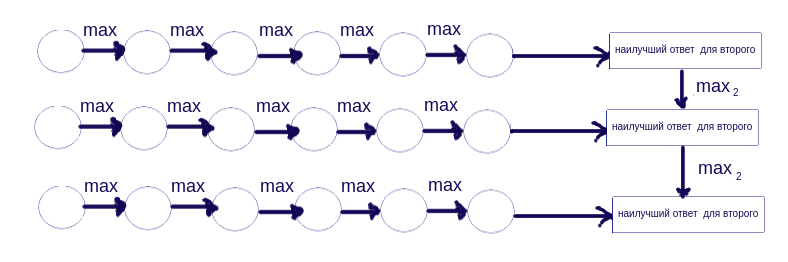

1.7 Информационный граф

Опишем граф алгоритма в виде рисунка.

Круглые элеменеты графа - элементы матрицы G. Под max, имеется в виду функция поиска максимума в строке (причем с уметом благожелательности).

max2 - опять же функция поиска максимума для первого, исходя из ответов второго.

1.8 Ресурс параллелизма алгоритма

Каждую строку можно обрабатывать отдельным процессором. Таким образом каждый процессор бежит по строке и ищет там максимум (с условием благосклонности к лидеру). После этого процессоры синхронизируются и мы ищем максимум из уже найденых значений, таким образом мы получаем наибольший выигрыш для лидера, после чего находим все равновесия по Штакельбергу.

Параллельная сложность: [math]О(m)[/math], где [math]m[/math] число столбцов а нашей матрице.

1.9 Входные и выходные данные алгоритма

Входными данными являются пара матриц [math] H(x,y) [/math], [math] G(x,y) [/math] одинакового размера [math]n * m [/math] (стратегии обоих игроков). Выходные данные это множество пар чисел [math] (x^*,y^*) [/math], где каждая из пар является равновесием по Штакельбергу в нашей дуаполии.

2 Программная реализация алгоритма

2.1 Особенности реализации последовательного алгоритма

2.2 Локальность данных и вычислений

2.3 Возможные способы и особенности параллельной реализации алгоритма

2.4 Масштабируемость алгоритма и его реализации

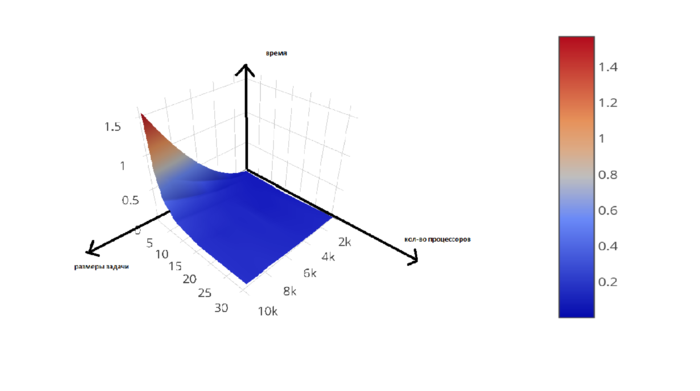

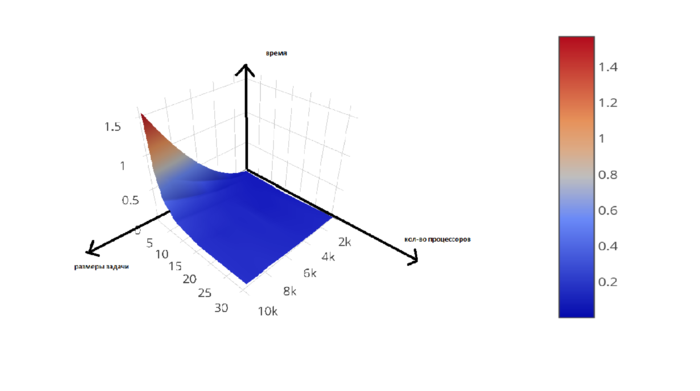

Проведём исследование масштабируемости параллельной реализации алгоритма. Набор и границы значений изменяемых параметров запуска реализации алгоритма:

число процессоров [1,2 4, 8 : 32] со значениями квадрата целого числа;

размер матрицы(для тестов бралась квадратная матрица) [1000:10000] с шагом 1000.

На следующем рисунке приведен график производительности выбранной реализации алгоритма в зависимости от изменяемых параметров запуска.

Рис.1. График маштабируемости

сведения о программно-аппаратной среде

компьютер: суперкомпьютор Ломоносов

компилятор с использованными опциями оптимизации: mpicxx версии openmpi/1.8.4-gcc

библиотеки: #include <mpi.h>, #include <iostream>, #include <cstdlib>, #include <ctime>, #include <vector>

выводы о масштабируемости

Мы получили ожидаемые результаты(в целом), что производительность увеличивается с

увеличеснием количества процессоров и уменьшается с увеличеннием количества строк.

Это можно объяснить тем, что выбранный алгоритм очень хорошо распараллеливается, а

«общение» процессоров почти не требуется (это важно так как эта процедура достаточно

ресурсозатратна).

2.5 Динамические характеристики и эффективность реализации алгоритма

2.6 Выводы для классов архитектур

2.7 Существующие реализации алгоритма

Написанная мной, текущая реализация алгоритма:

#include <mpi.h>

#include <iostream>

#include <cstdlib>

#include <ctime>

#include <vector>

using namespace std;

int main(int argc, char * argv[])

{

int comm_sz, my_rank;

MPI_Init(&argc, &argv);

MPI_Comm comm = MPI_COMM_WORLD;

MPI_Comm_size(comm, &comm_sz);

MPI_Comm_rank(comm, &my_rank);

//считываем размеры матрицы

int n,m;

if (my_rank == 0) {

n = strtol(argv[1], NULL, 10);

m = strtol(argv[2], NULL, 10);

}

MPI_Bcast(&m, 1, MPI_INT, 0, comm);

MPI_Bcast(&n, 1, MPI_INT, 0, comm);

//делим матрицу

int local_n = n / comm_sz;

int rem = n % comm_sz;

if(my_rank < rem) {

local_n++;

}

vector<vector<double> > G(local_n, vector<double> (m, -5)) , H(local_n, vector<double> (m, -5));

//генирируем мартицу

srand(time(NULL));

for(int i = 0; i < local_n; ++i) {

for(int j = 0; j < m; ++j) {

H[i][j] = rand();

G[i][j] = rand();

}

}

double s_time = 0;

if (rank == 0) {

s_time = MPI_Wtime();

}

//ищем максимум в G благожелательно к лидеру на каждую его стратегию

vector<int> local_ind(local_n);

vector<double> local_max(local_n);

for(int i = 0; i < local_n; ++i){

double max_in_line = G[i][0];

int ind_max = 0;

for(int j = 0; j < m; ++j){

if (G[i][j] > max_in_line) {

max_in_line = G[i][j];

ind_max = j;

} else if (G[i][j] == max_in_line) {

if (H[i][j] > H[i][ind_max]) {

ind_max = j;

max_in_line = G[i][j];

}

}

}

local_ind[i] = ind_max;

local_max[i] = H[i][ind_max];

}

//ищем с учетом ответа второго наилучшую тратегию для лидера

double max_in_proc = local_max[0];

for (int i = 0; i < local_n; ++i) {

if(max_in_proc < local_max[i]) {

max_in_proc = local_max[i];

}

}

double res_max;

MPI_Allreduce(&max_in_proc, &res_max, 1, MPI_DOUBLE, MPI_MAX, comm);

//ищем все равновесия по Штакельбергу

for (int i = 0; i < local_n; ++i) {

if(res_max == local_max[i]) {

//i, max_ind[i] равновесие по Штакельбергу

}

}

//выводим время

double f_time = 0;

if (rank == 0) {

f_time = MPI_Wtime();

cout << n << ' ' << f_time - s_time << endl;

}

MPI_Finalize();

}

3 Литература

- ↑ Шагин, В. Л. Теория игр с экономическими приложениями. Учебное пособие. — М., ГУ-ВШЭ, 2003.

- ↑ Васин А.А., Морозов В.В. "Введение в теорию игр с приложениями в экономике"(учебное пособие). - М.: 2003. - 278 с. Pages 131-132