Участник:Parkhomenko/Алгоритм k средних

| Алгоритм k средних | |

| Последовательный алгоритм | |

| Последовательная сложность | O(m*n*k*d) |

| Объём входных данных | n * d |

| Объём выходных данных | n |

Основные авторы описания: П.А.Пархоменко, И.Д.Машонский

Содержание

- 1 Свойства и структура алгоритмов

- 1.1 Общее описание алгоритма

- 1.2 Математическое описание алгоритма

- 1.3 Вычислительное ядро алгоритма

- 1.4 Макроструктура алгоритма

- 1.5 Схема реализации последовательного алгоритма

- 1.6 Последовательная сложность алгоритма

- 1.7 Информационный граф

- 1.8 Ресурс параллелизма алгоритма

- 1.9 Входные и выходные данные алгоритма

- 1.10 Свойства алгоритма

- 2 Программная реализация алгоритма

- 2.1 Особенности реализации последовательного алгоритма

- 2.2 Локальность данных и вычислений

- 2.3 Возможные способы и особенности параллельной реализации алгоритма

- 2.4 Масштабируемость алгоритма и его реализации

- 2.5 Динамические характеристики и эффективность реализации алгоритма

- 2.6 Выводы для классов архитектур

- 2.7 Существующие реализации алгоритма

- 3 Литература

1 Свойства и структура алгоритмов

1.1 Общее описание алгоритма

Алгоритм k средних (англ. k-means) - один из алгоритмов машинного обучения, решающий задачу кластеризации. Он был изобретен в середине 1950-х математиком Гуго Штейнгаузом[1] и Стюартом Ллойдом[2]. Алгоритм стал особо популярным после публикации Маккуина[3], в которой впервые был использован термин “k-means”.

Задача алгоритма кластеризации заключается в разбиении N объектов (d-мерных векторов) на K групп (кластеров). Каждый вектор может принадлежать только одному кластеру. Количество кластеров K фиксировано, оно задается в качестве параметра.

K-means является итерационным алгоритмом, разновидностью EM-алгоритма. Основная идея работы алгоритма заключается в проведении некоторого количества итераций, на каждой из которых происходит пересчет центра масс для каждого кластера, полученного на предыдущей итерации. После этого векторы перераспределяются по кластерам: вектор относится к тому кластеру, расстояние до центра масс которого минимально. Алгоритм завершает работу в том случае, если на очередной итерации центры масс кластеров не изменились.

1.2 Математическое описание алгоритма

Исходные данные: множество d-мерных векторов (наблюдений) X = \{x_1, x_2, ..., x_n\}, число кластеров k \in \mathbb{N}

В результате работы алгоритма исходное множество векторов X разбивается на k непересекающихся множеств (кластеров) S_1, S_2, ..., S_k, таких что X = {\bigcup \limits _{i = 1}^k S_i} и значение \sum_{i=1}^{k} \sum_{\mathbf x \in S_i} \left\| \mathbf x - \mu_i \right\|^2 — минимально для всех возможных наборов S_1, S_2, ..., S_k. Под \mu_i здесь подразумевается центр масс векторов из множества S_i.

Первоначальные значения центров масс \mu_1^{(1)}, ..., \mu_k^{(1)} определяются в начале работы алгоритма случайным образом среди векторов множества X.

Алгоритм заключается в попеременном применении двух шагов: распределения векторов по кластерам и обновления центров масс каждого кластера

Распределение векторов по кластерам: на данном шаге каждый вектор распределяется в один из кластеров S_i^{(t)}:

- S_i^{(t)} = \big \{ x_p : \big \| x_p - \mu^{(t)}_i \big \|^2 \le \big \| x_p - \mu^{(t)}_j \big \|^2 \ \forall j, 1 \le j \le k \big\},

Обновление центров масс: на данном шаге вычисляются новые центры масс для кластеров, полученных на предыдущем шаге.

- \mu^{(t+1)}_i = \frac{1}{|S^{(t)}_i|} \sum_{x_j \in S^{(t)}_i} x_j

Алгоритм завершается, когда на очередном шаге не происходит изменения центров масс кластеров.

1.3 Вычислительное ядро алгоритма

Вычислительное ядро последовательного алгоритма k-means состоит из двух операций, повторяющихся на каждой итерации алгоритма:

- пересчета центров масс кластеров;

- соотнесения каждого вектора к одному из кластеров.

Пересчет центра масс кластера заключается в нахождении d-мерного вектора, являющегося средним арифметическим d-мерных векторов, принадлежащих кластеру. Эту операцию необходимо выполнять для каждого из K кластеров.

Для соотнесения вектора к одному из кластеров, необходимо для каждого из N вектора посчитать расстояние до центров масс всех K кластеров. Для нахождения расстояния между двумя d-мерными векторами p и q используется Евклидова метрика: \sqrt{\sum_{k=1}^d (p_k-q_k)^2}

1.4 Макроструктура алгоритма

В начале алгоритма осуществляется инициализация центров масс \mu_1^{(1)}, ..., \mu_k^{(1)}, которая может быть реализована двумя возможными способами:

- случайный выбор центров масс среди исходных наблюдений x_1, x_2, ..., x_n;

- все наблюдения случайным образом распределяются по кластерам S_1, S_2, ..., S_k, а затем для каждого кластера выполняется операция обновления центра масс.

На шаге распределения векторов по кластерам производится операция нахождения квадратов расстояний между векторами кластера и центром масс кластера:

- \rho = \big \| x_p - \mu^{(t)}_i \big \|^2

На шаге обновления центров масс производится операция суммирования векторов кластера:

- \mu^{(t+1)}_i = \frac{1}{|S^{(t)}_i|} \sum_{x_j \in S^{(t)}_i} x_j

1.5 Схема реализации последовательного алгоритма

Последовательность исполнения метода следующая:

- Инициализируются центры масс \mu_1^{(1)}, ..., \mu_k^{(1)}

- t := 1

- Для каждого вектора x_i, i = 1, 2, ..., n вычисляется

m = \underset{j \in \{1, 2, ..., k\}} {\operatorname{arg\,min}} \big \| x_i - \mu^{(t)}_j \big \|^2,

вектор x_i распределяется в кластер S^{(t)}_m - Для каждого j = 1, 2, ..., k вычисляется

\mu^{(t+1)}_j = \frac{1}{|S^{(t)}_i|} \sum_{x_j \in S^{(t)}_i} x_j - Если \mu^{(t)}_j = \mu^{(t+1)}_j, j = 1, 2, ..., k, завершить выполнение алгоритма, иначе t := t + 1, переход на шаг 3.

1.6 Последовательная сложность алгоритма

Для вычисления центра массы кластера, содержащего n_i d-мерных векторов, необходимо:

- n_i * (d - 1) операций сложения

- d операций деления

Для определения центров масс всех k кластеров требуется:

- n * (d - 1) операций сложения

- k * d операций деления

Для определения расстояния между двумя d-мерными векторами, требуется:

- d операций вычитания

- d операций умножения

- d - 1 операций сложения

Для определения кластера для n d-мерного векторов, необходимо:

- n * k * d операций вычитания

- n * k * d операций умножения

- n * k * (d - 1) операций сложения

Таким образом, общая сложность одной итерации:

- O(n * k * d) операций сложения/вычитания

- O(n * k * d) операций умножения/деления

Сложность всего алгоритма, состоящего из m итераций: O(m * n * k * d)

1.7 Информационный граф

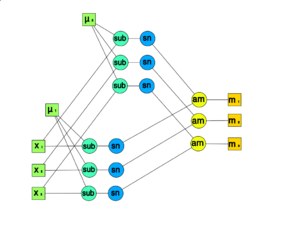

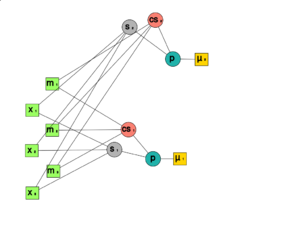

В данном разделе описывается информационный граф алгоритма k-средних при n = 3, k = 2

На рисунке 1 показана общая структура алгоритма: в качестве входных данных выступает матрица, строками которой являются входные векторы x_1, x_2, x_3, на выходе получается массив из n чисел, где элемент с номером i = 1, 2, 3 обозначает номер кластера, которому принадлежит вектор x_i. На шаге init происходит инициализация значений центров масс кластеров, после этого осуществляется итеративное повторение этапов распределения векторов по кластерам (as) и обновления значений центров масс кластеров (up).

Распределение векторов по кластерам. На рисунке 2 изображен информационный граф для этапа распределения векторов по кластерам. В качестве входных данных выступают строки входной матрицы (входные векторы) x_1, x_2, x_3 и текущие значения центров масс кластеров \mu_1, \mu_2 (вычисленные на этапе инициализации или предшествующего этапа обновления центров масс кластеров). В качестве выходных данных выступают числа m_1, m_2, m_3, где m_i, i = 1, 2, 3 - номер кластера, содержащего вектор x_i. Вершинами с пометкой sub обозначены операции векторной разности, врешинами sn - операция вычисления квадрата нормы вектора, вершинами am - операция

1.8 Ресурс параллелизма алгоритма

1.9 Входные и выходные данные алгоритма

Входные данные:

- целое неотрицательное число k - количество кластеров;

- матрица координат векторов A размерностью n * d.

Объем входных данных:

- n * d вещественных чисел (если координаты вещественные числа), 1 целое неотрицательное число.

Выходные данные:

- вектор длины n - для каждого вектора указан номер кластера.

Объем выходных данных:

- n целых неотрицательных чисел.

1.10 Свойства алгоритма

Стоит отметить следующие ключевые особенности алгоритма k средних:

- Алгоритм прост в реализации и имеет высокую скорость работы по сравнению с другими алгоритмами кластеризации (при удачном выборе начальных значений центров масс кластеров)

- В качестве метрики используется евклидово расстояние, а в качестве меры разброса кластера используется дисперсия

- Количество кластеров k является входным параметром алгоритма, поэтому неправильный выбор этого параметра может негативно повлиять на качество кластеризации

- Сходимость алгоритма к локальному минимуму может породить некорректный конечный результат работы

- Алгоритм очень чувствителен к выбору начальных центров масс кластеров: классический вариант подразумевает случайный их выбор, что может являться источником погрешности. Из этого и предыдущего свойства следует то, что алгоритм не является устойчивым.

Как и любой другой алгоритм кластеризации, результат работы алгоритма k средних зависит от того, удовлетворяет ли входной набор данных предположениям, на которые опираются алгоритмы кластеризации. Таким образом, на одних наборах данных алгоритм может показывать хорошие результаты, но на других выдавать некорректные результаты.

Алгоритм не является детерминированным, в силу того, что он чувствителен к выбору начальных центров масс кластеров, который осуществляется, как правило, случайным образом и тем самым вносит различия в работу алгоритма от запуска к запуску.

2 Программная реализация алгоритма

2.1 Особенности реализации последовательного алгоритма

2.2 Локальность данных и вычислений

2.3 Возможные способы и особенности параллельной реализации алгоритма

2.4 Масштабируемость алгоритма и его реализации

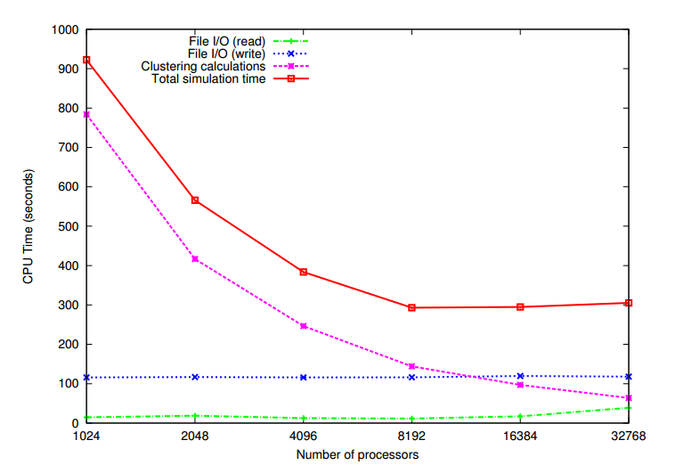

Исследование масштабируемости алгоритма k-means в зависимости от количества используемых процессов было проведено в статье Кумара[4]. Исследование происходило на суперкомпьютере Jaguar - Cray XT5[5]. На момент экспериментов данный суперкомпьютер имел следующую конфигурацию: 18,688 вычислительных узлов с двумя шестнадцатиядерными процессорами AMD Opteron 2435 (Istanbul) 2.6 GHz, 16 GB of DDR2-800 оперативной памяти, и SeaStar 2+ роутер. Всего он состоял из 224,256 вычислительных ядер, 300 TB памяти, и пиковой производительностью 2.3 petaflops.

Реализация алгоритма была выполнена на языке программирования C с использованием MPI.

Объем данных составлял 84 гигабайта, количество объектов (m-мерных векторов) n равнялось 1,024,767,667, размерность векторов m равнялось 22, количество кластеров k равнялось 1000.

На рисунке 4 показана зависимости времени работы алгоритма кластеризации k-means в зависимости от количества используемых процессоров. Можно отметить, что время, затраченное на чтение данных и запись результатов кластеризации, практически не изменяется с увеличением количества задействованных процессоров. Время же работы самого алгоритма кластеризации уменьшается с увеличением количества процессоров.

2.5 Динамические характеристики и эффективность реализации алгоритма

2.6 Выводы для классов архитектур

2.7 Существующие реализации алгоритма

Существуют следующие реализации алгоритма k-средних:

- scikit-learn библиотека машинного обучения для языка Python.

- SciPy библиотека на языке Python, содержащая большое число реализаций различных алгоритмов, в том числе k-средних.

- ELKI библиотека для анализа данных на языке программирования Java, содержит различные алгоритмы кластеризации, в том числе k-средних.

- MLPACK библиотека машинного обучения для C++, содержит реализацию алгоритма k-средних.

- Julia k-means реализация алгоритма k-средних на языке программирования Julia.

- OpenCV библиотека содержит реализацию k-средних.

- Apache Mahout содержит реализацию алгоритма k-средних на базе MapReduce.

- Weka библиотека и инструмент для анализа данных на языке Java.

- Torch библиотека машинного обучения на базе языка программирования Lua.

- Apache Spark MLlib содержит распределенную реализацию алгоритма k-средних.

- Accord.NET содержит несколько различных реализаций k-средних на языке C#.

- R k-means реализация k-средних на языке R.

3 Литература

<references \>

- ↑ Steinhaus H. (1956). Sur la division des corps materiels en parties. Bull. Acad. Polon. Sci., C1. III vol IV: 801—804.

- ↑ Lloyd S. (1957). Least square quantization in PCM’s. Bell Telephone Laboratories Paper.

- ↑ MacQueen J. (1967). Some methods for classification and analysis of multivariate observations. In Proc. 5th Berkeley Symp. on Math. Statistics and Probability, pages 281—297.

- ↑ Kumar J. et al. Parallel k-means clustering for quantitative ecoregion delineation using large data sets //Procedia Computer Science. – 2011. – Т. 4. – С. 1602-1611.

- ↑ https://www.top500.org/system/176029