Метод Хаусхолдера (отражений) для приведения комплексных эрмитовых матриц к трёхдиагональному симметричному виду

| Приведение эрмитовой комплексной матрицы к трёхдиагональному виду методом Хаусхолдера (отражений) | |

| Последовательный алгоритм | |

| Последовательная сложность | O(n^3) |

| Объём входных данных | (n^2+n)/2 |

| Объём выходных данных | (n^2+3n)/2 |

| Параллельный алгоритм | |

| Высота ярусно-параллельной формы | 2n^2+O(n) |

| Ширина ярусно-параллельной формы | n^2/2 |

Основные авторы описания: А.В.Фролов

Содержание

- 1 Свойства и структура алгоритма

- 1.1 Общее описание алгоритма

- 1.2 Математическое описание алгоритма

- 1.3 Вычислительное ядро алгоритма

- 1.4 Макроструктура алгоритма

- 1.5 Схема реализации последовательного алгоритма

- 1.6 Последовательная сложность алгоритма

- 1.7 Информационный граф

- 1.8 Ресурс параллелизма алгоритма

- 1.9 Входные и выходные данные алгоритма

- 1.10 Свойства алгоритма

- 2 Программная реализация алгоритма

- 3 Литература

1 Свойства и структура алгоритма

1.1 Общее описание алгоритма

Метод Хаусхолдера (в советской математической литературе чаще называется методом отражений) используется для приведения эрмитовых комплексных матриц к трёхдиагональному виду, или, что то же самое, для разложения A=QTQ^* (Q - унитарная, T — симметричная вещественная трёхдиагональная матрица)[1]. При этом матрица Q хранится и используется не в своём явном виде, а в виде произведения матриц отражения[2]. Каждая из матриц отражения может быть определена одним вектором. Это позволяет в классическом исполнении метода отражений хранить результаты разложения на месте матрицы A с использованием одномерного дополнительного массива.

В данной статье рассматривается именно классическое исполнение, в котором не используются приёмы типа сдваивания при вычислениях скалярных произведений.

1.2 Математическое описание алгоритма

В методе Хаусхолдера для выполнения QTQ^*-разложения матрицы используются умножения слева её текущих модификаций на матрицы Хаусхолдера (отражений) с последующим умножением на те же матрицы справа.

Матрица отражений (Хаусхолдера) - матрица вида U=E-2ww^*, где w - вектор, удовлетворяющий равенству w^{*}w=1. Является одновременно унитарной (U^{*}U=E) и эрмитовой (U^{*}=U), поэтому обратна самой себе (U^{-1}=U).

На i-м шаге метода с помощью преобразования отражения "убираются" ненулевые поддиагональные элементы, начиная с i+2-го в i-м столбце. После умножения на эту же матрицу отражения справа автоматически убираются и ненулевые наддиагональные элементы, начиная с i+2-го в i-й строке, а полученная модификация снова приобретает симметричный вид.

На каждом из шагов метода матрицу отражений обычно представляют не в стандартном виде, а в виде U=E-\frac{1}{\gamma}vv^*, где v находится через координаты текущего i-го столбца так:

s - вектор размерности n+1-i, составленный из элементов i-го столбца, начиная с i-го.

Если (s,s)=0, то v=e_{i}, \gamma = \frac{1}{2}.

В остальных случаях по алгоритму вычисляется u = \frac{1}{\sqrt{(s,s)}}s, и далее v_{j}=0 при j \lt i, v_{j}=u_{j-i+1} при j \gt i, а v_{i}=1, если u_{1}=0 и v_{i}=\frac{u_{1}}{|u_{1}|}(1+|u_{1}|) для остальных значений. При этом \gamma = 1+|u_{1}|=|v_{i}|.

После вычисления вектора v подстолбцы справа от ведущего модифицируются по формулам x'=x-\frac{(x,v)}{\gamma}v. Потом по аналогичным формулам модифицируются строки ниже ведущей. Благодаря ассоциативности этих операций после вычисления вектора v можно сразу выписать формулы модификации всех элементов справа и снизу от ведущих столбца и строки. Оказывается, что если для каждого столбца матрицы x^{(j)} с номером j известно \beta_{j}=\frac{(x^{(j)},v)}{\gamma}, то для модифицируемого элемента матрицы y в позиции (i,j) выполняется модификация y' = y - \beta_{i} v_{i} - \beta_{j} v_{j} - \Delta v_{i} v_{j}, где \Delta = \frac{(\beta,v)}{\gamma}. При этом все эти модификации на каждом конкретном шаге алгоритма для разных пар (i,j) можно выполнять независимо друг от друга, в том числе и параллельно.

1.3 Вычислительное ядро алгоритма

Основную часть алгоритма составляют вычисления на каждом шагу скалярных произведений (s,s) и (x,v) для всех подстолбцов xсправа от текущего, а также проводимые над нижним правым квадратом матрицы операции вида y'=y-a \overline b-c \overline d-fb \overline d, с учётом симметрии матрицы.

1.4 Макроструктура алгоритма

Как уже сказано в описании ядра, основная часть - вычисления на каждом шагу скалярных произведений (s,s) и (x,v) для всех подстолбцов x справа от текущего, а также массовые покомпонентные операции y'=y-a \overline b-c \overline d-fb \overline d. При этом, однако, строгая последовательность выполнения первых двух подшагов не обязательна, в силу связи получаемых векторов s и v можно одновременно с (s,s) вычислять и произведения (x,s) с последующим выражением через них коэффициентов модификации. Это позволяет почти вдвое уменьшать критический путь графа алгоритма.

1.5 Схема реализации последовательного алгоритма

Последовательность выполнения алгоритма обычно записывается как последовательное "обнуление" поддиагональных элементов столбцов, начиная с 1-го столбца и заканчивая предпоследним (n-1)-м.

При этом в каждом "обнуляемом" i-м столбце "обнуляются" сразу все его поддиагональные элементы одновременно, с (i+1)-го до n-го.

Каждое "обнуление" i-го столбца состоит из двух шагов: а) вычисление параметров матрицы отражения U_{i} такой, чтобы при умножении на неё слева "обнулились" все поддиагональные его элементы; б) одновременное умножение слева матрицы отражения U_{i} и справа матрицы отражения U_{i}^Tна текущую версию матрицы.

1.6 Последовательная сложность алгоритма

В последовательной версии основная сложность алгоритма определяется прежде всего вычислениями скалярных произведений векторов, а также массовых модификаций элементов вида y'=y-\alpha v - \beta w - \Delta vw. Они, если не учитывать возможную разреженность, составляют (в главном члене) по O(n^3) операций комплексного умножения и сложения/вычитания.

При классификации по последовательной сложности, таким образом, метод Хаусхолдера относится к алгоритмам с кубической сложностью.

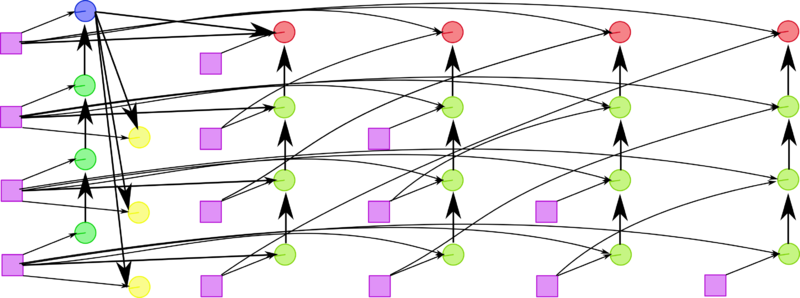

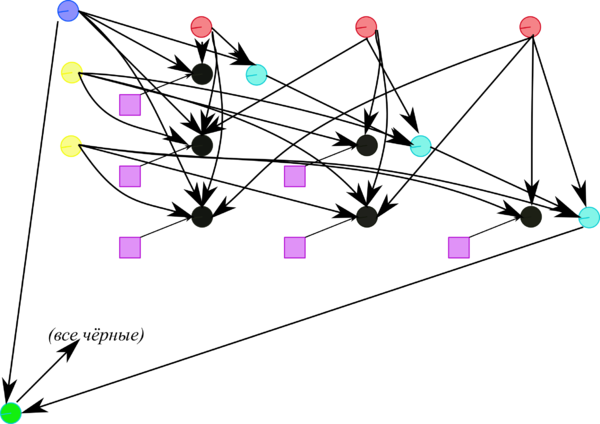

1.7 Информационный граф

На рисунках 1 и 2 приведён граф алгоритма шага метода Хаусхолдера в наиболее его быстром (с параллельной точки зрения) варианте, использующем то, что с точностью до множителя ведущий вектор матрицы отражения отличается отличается от подстолбца, где выполняется очередное исключение, только одним элементом.

1.8 Ресурс параллелизма алгоритма

Для понимания ресурса параллелизма в симметричном приведении матрицы порядка n к трёхдиагональной методом Хаусхолдера нужно рассмотреть критический путь графа.

Как видно из описания разных вершин, вычисления при "обнулении" i-го столбца параметров отражения и скалярных произведений состоят из основной части - ветви длиной по 2(n-i) умножений и сложений - и коррекции вычислений, которые составляют O(1) операций.

Поэтому по грубой (без членов низших порядков) оценке критический путь метода Хаусхолдера будет идти через n^2 комплексных умножений и n^2 комплексных сложений/вычитаний.

Поэтому в параллельном варианте, как и в последовательном, основную долю требуемого для выполнения алгоритма времени будут определять операции вида a+b \overline c.

При классификации по высоте ЯПФ, таким образом, метод Хаусхолдера относится к алгоритмам с квадратичной сложностью. При классификации по ширине ЯПФ его сложность будет также квадратичной (без расширения ряда ярусов, связанных с векторными операциями сложения, пришлось бы увеличить вдвое длину критического пути).

1.9 Входные и выходные данные алгоритма

Входные данные: плотная эрмитова квадратная матрица A (элементы a_{ij}).

Объём входных данных: (n^2+n)/2 комплексных чисел.

Выходные данные: трёхдиагональная симметричная вещественная матрица D (ненулевые элементы r_{ij} в последовательном варианте хранятся в элементах исходной матрицы a_{ij}), унитарная матрица Q - как произведение матриц Хаусхолдера (отражения) (их вектора нормалей к плоскостям отражения в последовательном варианте хранятся в поддиагональных элементах исходной матрицы a_{ij} и в одном дополнительном столбце размерности n).

Объём выходных данных: (n^2+n)/2 комплексных и n вещественных чисел.

1.10 Свойства алгоритма

Соотношение последовательной и параллельной сложности, как хорошо видно, является линейным, что даёт определённый стимул для распараллеливания. Однако у наискорейшей ЯПФ ширина квадратична, что указывает на дисбаланс между загруженностями устройств при попытке её реально запрограммировать. Поэтому более практично даже при хорошей (быстрой) вычислительной сети оставить количество устройств (например, узлов кластера) линейным по размеру матрицы, что удвоит критический путь реализуемой ЯПФ.

При этом вычислительная мощность алгоритма, как отношение числа операций к суммарному объему входных и выходных данных, линейна.

Алгоритм в рамках выбранной версии полностью детерминирован.

Вычислительная погрешность в методе отражений (Хаусхолдера) растет линейно, как и в методе Гивенса (вращений).