Участник:Denemmy/Partitioning Around Medoids (Алгоритм): различия между версиями

Ivan.Z (обсуждение | вклад) |

Ivan.Z (обсуждение | вклад) |

||

| Строка 213: | Строка 213: | ||

== Литература == | == Литература == | ||

<references /> | <references /> | ||

| + | |||

| + | [Fasulo D. An analysis of recent work on clustering algorithms. – Technical report, 1999. – №. 01-03. – С. 02.] | ||

| + | [Park H. S., Jun C. H. A simple and fast algorithm for K-medoids clustering //Expert Systems with Applications. – 2009. – Т. 36. – №. 2. – С. 3336-3341.] | ||

| + | [Van der Laan M., Pollard K., Bryan J. A new partitioning around medoids algorithm //Journal of Statistical Computation and Simulation. – 2003. – Т. 73. – №. 8. – С. 575-584.] | ||

| + | [Нейский И. М. Классификация и сравнение методов кластеризации //ББК 32.813 И 76 Составитель: ЮН Филиппович. – 2006. – С. 130.] | ||

Версия 21:55, 15 октября 2016

| Partitioning Around Medoids | |

| Последовательный алгоритм | |

| Последовательная сложность | O(T*K*N^2) |

| Объём входных данных | N*(N-1)/2 + 2 |

| Объём выходных данных | N |

Авторы: Галеев Д.Ф, Запутляев И.

Содержание

- 1 Свойства и структура алгоритма

- 1.1 Общее описание алгоритма

- 1.2 Математическое описание алгоритма

- 1.3 Вычислительное ядро алгоритма

- 1.4 Макроструктура алгоритма

- 1.5 Схема реализации последовательного алгоритма

- 1.6 Последовательная сложность алгоритма

- 1.7 Информационный граф

- 1.8 Ресурс параллелизма алгоритма

- 1.9 Входные и выходные данные алгоритма

- 1.10 Свойства алгоритма

- 2 Программная реализация алгоритма

- 2.1 Особенности реализации последовательного алгоритма

- 2.2 Локальность данных и вычислений

- 2.3 Возможные способы и особенности параллельной реализации алгоритма

- 2.4 Масштабируемость алгоритма и его реализации

- 2.5 Динамические характеристики и эффективность реализации алгоритма

- 2.6 Выводы для классов архитектур

- 2.7 Существующие реализации алгоритма

- 3 Литература

1 Свойства и структура алгоритма

1.1 Общее описание алгоритма

Кластеризация - это задача из области машинного обучения, которая заключается в том, что нужно выделить некоторое число групп в исходном множестве, в каждой из которых содержатся схожие по некоторой метрике элементы.

Partitioning Around Medoids (PAM) - это одна из реализаций алгоритма кластеризации k-medoids. PAM использует жадный алгоритм, который может не найти оптимального решения, однако он гораздо быстрее полного перебора.

1.1.1 ========

Алгоритм Partitioning Around Medoids (PAM) был создан Леонардом Кауфманом и Питером Россеву и он очень похож на алгоритм K-means, в основном потому, что оба являются алгоритмами кластеризации, другими словами, оба разделяют множество объектов на группы (кластеры) и работа обоих основана на попытках минимизировать ошибку, но PAM работает с медоидами - объектами, являющимися частью исходного множества и представляющими группу, в которую они включены, а K-means работает с центроидами - искусственно созданными объектами, представляющими кластер.

Алгоритм PAM разделяет множество из N объектов на K кластеров, где и множество объектов, и число K являются входными данными алгоритма. Алгоритм работает с матрицей непохожести, чья цель - минимизировать общую непохожесть между представителями каждого кластера и его членами. Алгоритм использует следующую модель для решения задачи: {\displaystyle F(x)={\text{minimize}}\sum _{i=1}^{n}\sum _{j=1}^{n}d(i,j)z_{ij}} {\displaystyle F(x)={\text{minimize}}\sum _{i=1}^{n}\sum _{j=1}^{n}d(i,j)z_{ij}}

Пусть:

Σ i=1 n zij = 1 , j = 1,2,...,n zij ≤ yi , i, j = 1,2,...,n Σ i=1 n yi = k , k = число кластеров yi , zij € {0,1} , i, j = 1,2,...,n

где функция F(x) - целевая минимизируемая функция, d(i,j) - мера непохожести между объектами i и j, z_ij - переменная, которая гарантирует, что непохожесть только между объектами из одного кластера будет вычислена в целевой функции. Остальные выражения являются следующими ограничениями: 1. Каждый объект принадлежит одному и только одному кластеру 2. Каждый объект относится к медоиде, представляющей его кластер 3. Есть в точности K кластеров 4. Решающая переменная принимает значения 0 или 1

PAM может работать с двумя типами входных данных: 1. С матрицей объектов и значениями ее переменных 2. Напрямую с матрицей непохожести В последнем случае пользователь может подать матрицу непохожести на вход алгоритму, вместо матрицы, представляющей объекты.

В любом случае, алгоритм находит решение задачи. Алгоритм работает следующим образом: Фаза Build: 1. Выбрать K объектов в качестве медоид 2. Построить матрицу непохожести, если она не была задана 3. Отнести каждый объект к ближайшей медоиде

Фаза Swap: 4. Для каждого кластера найти объекты, снижающие коэффициент средней непохожести, и если такие объекты есть, выбрать те, которые снижают его сильней всего, в качестве медоид 5. Если хотя бы одна медоида поменялась, вернуться к шагу 3, иначе завершить алгоритм.

Как уже было сказано, PAM работает с матрицей непохожести, для построения которой алгоритм использует две метрики. Первая - евклидова, явялющаяща корнем из суммы квадратов разностей, вторая - манхетонское расстояние, являющееся суммой модулей расстояний.

1.2 Математическое описание алгоритма

Входные данные:

1. Множество X = \{ x_{1}, x_{2}, \dots, x_{N} \} объектов x_i, каждый из который задается P вещественными значениями;

2. Симметрическая матрица D, элементы d_{ij} = d(i,j) которой являются расстояниями между объектами x_i и x_j;

3. Число кластеров K \le N;

4. Метрика d_{ij} = d(i,j), задающая расстояние между объектами x_i и x_j.

Вычислительные формулы метода:

Фаза Build:

Фаза Swap:

Выходные данные:

1. M = \{ x_{m_{1}}, x_{m_{2}}, ..., x_{m_{K}} \} - множество медоид;

2. K_{m_i} = \{ x_{o_h} \in O \| x_{m_i} = \arg \min_{x_{m_s} \in M} \rho (x_{o_h}, x_{m_s}) \}, 1 \leq i \leq k- множество искомых кластеров.

1.3 Вычислительное ядро алгоритма

1.4 Макроструктура алгоритма

Если на вход алгоритма была подана не матрица расстояний, а матрица объектов с их координатами в пространстве R^P, то операция вычисления расстояния между объектами a и b размерности P будет являться макрооперацией. В качестве меры расстояния может быть использована евклидова метрика: d(a,b) = \sqrt{(a_1-b_1)^2+(a_2-b_2)^2+\dots+(a_P-b_P)^2} = \sqrt{\sum_{i=1}^P (a_i-b_i)^2}

1.5 Схема реализации последовательного алгоритма

Псевдокод алгоритма:

1 функция PAM(D, k, tmax=100):

2 # D - матрица расстояний, k - число кластеров, tmax - маскимальное число итераций

3 выполнить фазу BUILD, получить множество метоидов M и множество не-метоидов L

4 вычислить значение целевой функции F

5 для t = 0..tmax-1:

6 выполнить фазу SWAP, вычислить значение целевой функции F'

7 delta = F - F'

8 если delta > 0:

9 обновить множества M и L

10 F = F'

11 иначе:

12 выйти из цикла

13 вернуть М

1.6 Последовательная сложность алгоритма

Обозначим количество кластеров как K, количество объектов как N, число итераций алгоритма как T.

На стадии BUILD каждый шаг нахождения очередного метоида имеет сложность O(N^2) по количеству операций сложения вещественных чисел и по количеству операций сравнения двух вещественных чисел.

Тогда стадия BUILD имеет сложность O(K*N^2)

На стадии SWAP вычисление целевой функции имеет сложность O(K*N^2) по количеству операций сложения вещественных чисел и по количеству операций сравнения двух вещественных чисел.

Таким образом алгоритм PAN имеет сложность O(T*K*N^2)

1.7 Информационный граф

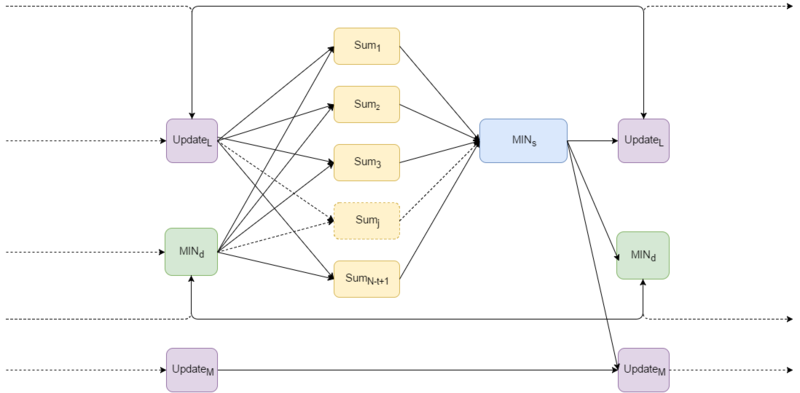

Фаза BUILD

Общий вид информационного графа для шага t представлен на рисунке 1:

Операции

- Update_M и Update_L - операции обновления множества метоидов и не-метоидов соответственно

- SUM - вычисление функции ошибки, на вход подается расстояния от очередного объекта до всех остальных, а также минимальные расстояния от выбранных на данном шаге метоидов до всех остальных вершин

- MIN_s - нахождение аргумента, соответствующего минимальному значению, а также само минимальное значение

- MIN_d - нахождение минимальных расстояний от медоидов до остальных вершин, используется в операции SUM

Количество шагов t равно K, где K - число кластеров

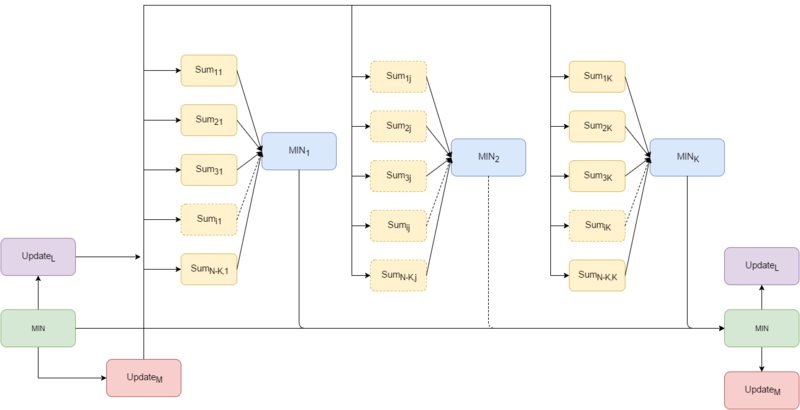

Фаза SWAP

Общий вид информационного графа для итерации t представлен на рисунке 2:

Операции

- Update_M и Update_L - операции обновления множества метоидов и не-метоидов соответственно

- SUM - вычисление целевой функции

- MIN - нахождение аргумента, соответствующего минимальному значению, а также само минимальное значение

1.8 Ресурс параллелизма алгоритма

Пусть число кластеров равно K, а число объектов равно N. Тогда параллельная сложность фазы BUILD имеет O(K*N) операций сложения и O(K*N) операций сравнения двух вещественных чисел. Таким образом параллельная сложность фазы BUILD равна O(K*N*T).

Параллельная сложность фазы SWAP имеет O(K*N) операций сложения и O(K*N) операций сравнения двух вещественных чисел. Параллельная сложность фазы SWAP равна O(K*N*T).

Таким образом параллельная сложность алгоритма равна [math]O(K*N*T)[/math].

1.9 Входные и выходные данные алгоритма

Входные данные:

* число [math]K[/math] - количество кластеров; * число [math]N[/math] - количество объектов; * вектор попарных расстояний, имеющий длину [math]N*(N-1)/2[/math], из данных чисел однозначно восстанавливается симметрическая матрица расстояний [math]D[/math]

Объём входных данных: N*(N-1)/2 вещественное число и 2 целых числа.

Выходные данные:

* K чисел [math]m_1, m_2, ..., m_K[/math] - индексы объектов соответствующие метоидам; * N-K чисел [math]k_1, k_2, ..., k_{N-K}[/math] - номера кластеров для каждого объекта (кроме тех, что являются метоидами);

Объём выходных данных: N целых чисел.

1.10 Свойства алгоритма

Вычислительная мощность алгоритма k means равна \frac{K*N^2*\Tau}{N^2} = K*\Tau , где K – число кластеров, \Tau – число итераций алгоритма.

Детерминированность и Устойчивость

Алгоритм PAM является итерационным, количество итераций может быть ограничено сверху, однако в общем случае не фиксируется. Из-за недетермирированности выбора элементов, на которых достигается минимум целевой функции, алгоритм не является детермирированным. Однако, данный алгоритм является устойчивым, поскольку не накапливает ошибки в процессе своей работы.

Сильные стороны алгоритма:

- Меньшая чувствительность к выбросам, чем k-means

- Несложность реализации

-

Возможность распараллеливания

Однако равномерная загрузка процессоров не всегда возможна.

Недостатки алгоритма:

- Квадратичная сложность алгоритма

-

Количество кластеров является параметром алгоритма

Во многих задачах число кластеров может быть неизвестным.

-

Возможность сходимости к локальному оптимуму

Оптимальное решение не гарантировано.

2 Программная реализация алгоритма

2.1 Особенности реализации последовательного алгоритма

2.2 Локальность данных и вычислений

2.3 Возможные способы и особенности параллельной реализации алгоритма

2.4 Масштабируемость алгоритма и его реализации

2.5 Динамические характеристики и эффективность реализации алгоритма

2.6 Выводы для классов архитектур

2.7 Существующие реализации алгоритма

- ELKI реализует несколько вариантов алгоритма кластеризации, включая алгоритм PAM. Написан на Java

- Java-ML. Включает реализацию k-metoid. Написан на Java

- Julia содержит реализацию k-metoid в пакете для кластеризации JuliaStats

- R включает различные варианты k-means в пакете flexclust. Алгоритм PAM реализован в пакете cluster

- MATLAB. Реализованы PAM, CLARA и другие алгоритмы кластеризации

- Python. Алгоритм PAM реализован как k-medoids в пакете pyclust, содержащем также различные варианты k-means

3 Литература

[Fasulo D. An analysis of recent work on clustering algorithms. – Technical report, 1999. – №. 01-03. – С. 02.]

[Park H. S., Jun C. H. A simple and fast algorithm for K-medoids clustering //Expert Systems with Applications. – 2009. – Т. 36. – №. 2. – С. 3336-3341.]

[Van der Laan M., Pollard K., Bryan J. A new partitioning around medoids algorithm //Journal of Statistical Computation and Simulation. – 2003. – Т. 73. – №. 8. – С. 575-584.]

[Нейский И. М. Классификация и сравнение методов кластеризации //ББК 32.813 И 76 Составитель: ЮН Филиппович. – 2006. – С. 130.]