Участник:Amirida/Метод «разделяй и властвуй» вычисления собственных значений и векторов симметричной трехдиагональной матрицы

| Эта работа прошла предварительную проверку Дата последней правки страницы: 03.02.2017 Данная работа соответствует формальным критериям. Проверено ASA. |

Метод «разделяй и властвуй» вычисления собственных значений и векторов симметричной трехдиагональной матрицы.

Авторы:

Изотова И.А. (619 группа) пункты 1.1, 1.2, 1.5, 1.7, 1.9

Ульянов Г.В. (619 группа) пункты 1.3, 1.4, 1.6, 1.8, 1.10

Содержание

- 1 Свойства и структура алгоритма

- 1.1 Общее описание алгоритма

- 1.2 Математическое описание алгоритма

- 1.3 Вычислительное ядро алгоритма

- 1.4 Макроструктура алгоритма

- 1.5 Схема реализации последовательного алгоритма

- 1.6 Последовательная сложность алгоритма

- 1.7 Информационный граф

- 1.8 Ресурс параллелизма алгоритма

- 1.9 Входные и выходные данные алгоритма

- 1.10 Свойства алгоритма

- 2 Программная реализация алгоритма

- 2.1 Особенности реализации последовательного алгоритма

- 2.2 Локальность данных и вычислений

- 2.3 Возможные способы и особенности параллельной реализации алгоритма

- 2.4 Масштабируемость алгоритма и его реализации

- 2.5 Динамические характеристики и эффективность реализации алгоритма

- 2.6 Выводы для классов архитектур

- 2.7 Существующие реализации алгоритма

- 3 Литература

1 Свойства и структура алгоритма

1.1 Общее описание алгоритма

«Разделяй и властвуй» - метод вычисления собственных значений и векторов симметричной трехдиагональной матрицы. В настоящее время это один из самых быстрых методов при вычислении собственных значений и векторов симметричной трехдиагональной матрицы порядка n \gt 25 (точное значение этого порогового порядка зависит от компьютера.) Однако алгоритм не гарантирует высокой относительной точности для малых собственных значений.Его численно устойчивая реализация весьма не тривиальна. Хотя впервые метод был предложен еще в 1981 г., "правильный" способ его реализации был найден лишь в 1992 г. Этот способ воплощен LAPACK-программами ssyevd (для плотных матриц) и sstevd (для трехдиагональных матриц). В них стратегия "разделяй-и-влавствуй" используется для матриц порядка, большего чем 25. Для матриц меньшего порядка (или если нужны только собственные значения) происходит автоматический переход к QR-итерации. Однако, из-за высокой сложности, алгоритм пока не вошел в состав ALGLIB.

В наихудшем случае алгоритм «разделяй-и-властвуй» требует O(n^{3}) операций, но константа, на практике оказывается весьма малой. Для некоторых специальных распределений собственных значений — O(n^{2}) (подробнее в разделе 1.6 Последовательная сложность алгоритма).

1.2 Математическое описание алгоритма

Разделяй

Пусть матрицы T, T_{1}, T_{2} имеют размерность n \times n, m \times m, (n - m) \times (n - m).

Запишем матрицу T в следующем виде:

- T = \begin{bmatrix} a_{1} & b_{1}&&&&& \\ b_{1} & \ddots & \ddots \\ & \ddots & a_{m-1} & b_{m-1} \\ && b_{m-1} & a_{m} & b_{m} \\ &&& b_{m} & a_{m+1} & b_{m+1} \\ &&&& b_{m+1} & \ddots \\ &&&&&& \ddots & b_{n-1} \\ &&&&&& b_{n-1} & a_{n} \\ \end{bmatrix} = \begin{bmatrix} a_{1} & b_{1} &&&&& \\ b_{1} & \ddots & \ddots \\ & \ddots & a_{m-1} & b_{m-1} \\ && b_{m-1} & a_{m} - b_{m} \\ &&&& a_{m+1} - b_{m} & b_{m+1} \\ &&&& b_{m+1} & \ddots \\ &&&&&& \ddots & b_{n-1} \\ &&&&&& b_{n-1} & a_{n} \\ \end{bmatrix} +

+ \begin{bmatrix} b_{m} & b_{m} \\ b_{m} & b_{m} \\ \end{bmatrix} = \begin{bmatrix} T_{1} & 0 \\ 0 & T_{2} \end{bmatrix} + b_{m} * \begin{bmatrix} 0 \\ \vdots \\ 0 \\ 1 \\ 1 \\ 0 \\ \vdots \\ 0 \end{bmatrix} \begin{bmatrix} 0 , \ldots , 0 , 1 , 1 , 0 \ldots , 0 \end{bmatrix} \equiv \begin{bmatrix} T_{1} & 0 \\ 0 & T_{2}\end{bmatrix} + b_{m}vv^{T}

Предположим, что нам известны спектральные разложения матриц \hat{T}_{1} и \hat{T}_{2}, т.е.: \hat{T}_{1} = Q_{1} D_{1} Q_{1}^{T} и \hat{T}_{2} = Q_{2} D_{2} Q_{2}^{T}.

Властвуй

Установим связь между собственными значениями матрицы T и собственными значениями матриц T_{1} и T_{2}:

T = \begin{bmatrix} T_{1} & 0 \\ 0 & T_{2}\end{bmatrix} + b_{m}vv^{T} = \begin{bmatrix} Q_{1} \Lambda_{1} Q_{1}^{T} & 0 \\ 0 & Q_{2} L_{2} Q_{2}^{T}\end{bmatrix} + b_{m}vv^{T} = \begin{bmatrix} Q_{1} & 0 \\ 0 & Q_{2}\end{bmatrix}(\begin{bmatrix} \Lambda_{1} & \\ & \Lambda_{2}\end{bmatrix} + b_{m}uu^{T})\begin{bmatrix} Q_{1}^{T} & 0 \\ 0 & Q_{2}^{T}\end{bmatrix} ,

где u = \begin{bmatrix} Q_{1}^{T} & 0 \\ 0 & Q_{2}^{T}\end{bmatrix}v - матрица, в первой строке которой находятся элементы последнего столбца матрицы Q_{1}^{T}, а во второй - элементы первого столбца матрицы Q_{2}^{T}, так как v = \begin{bmatrix} 0 , \ldots , 0 , 1 , 1 , 0 \ldots , 0 \end{bmatrix}^T. Следовательно, T имеет такие же собственные значения, что и подобная ей матрица D + \rho uu^{T}, где D =\begin{bmatrix} \Lambda_{1} & 0 \\ 0 & \Lambda_{2}\end{bmatrix} - диагональная матрица, \rho = b_{m} - число, а u - вектор. В дальнейшем предполагаем, не ограничивая общности, что диагональные элементы d_{1}, \ldots, d_{n} матрицы D упорядочены по не возрастанию: d_{n} \lt = \ldots \lt =d_{1}.

Для того, чтобы найти собственные значения матрицы D + \rho uu^{T}, потребуется вычислить её характеристический многочлен, считая пока матрицу D - \lambda I невырожденной. Тогда получаем det(D + \rho uu^{T} - \lambda I) = det((D - \lambda I)(I + \rho (D- \lambda I)^{-1} uu^{T})).

Так как D - \lambda I невырожденная, det(I + \rho (D - \lambda I)^{-1}uu^{T}) = 0 тогда и только тогда, когда \lambda - является собственным значением. Можем заметить, что матрица I + \rho (D - \lambda I)^{-1}uu^{T} получается из единичной путём добавления матрицы ранга 1. Определитель такой матрицы не сложно вычислить.

Лемма 1. Справедливо равенство [math]det(I + xy^{T}) = 1 + y^{T}x[/math], где [math]x[/math] и [math]y[/math] - векторы.

Следовательно, получаем det(I + \rho (D - \lambda I)^{-1}uu^{T}) = 1 + \rho u^{T}(D - \lambda I)^{-1}u = 1 + \rho \sum_{i=1, n} \frac{u_{i}^{2}} {d_{i}-\lambda} \equiv f(\lambda) ,

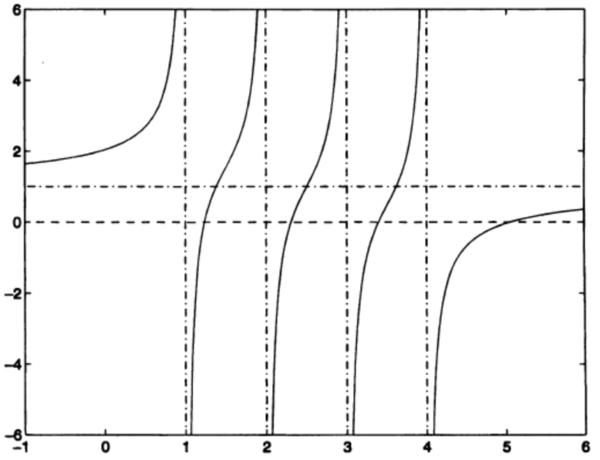

т.е. собственные значения матрицы T являются корнями так называемого векового уравнения f(\lambda) = 0. Если все числа d_{i} различны между собой и все u_{i} \lt \gt 0 (случай общего положения), то f(\lambda) имеет график типа, который показан на рис.1(где n = 4 и \rho \gt 0).

По Рис.1 можно заметить, что прямая y = 1 является горизонтальной асимптотой для данного графика, а прямые \lambda = d_{i} есть вертикальные асимптоты. Так как f^{'}(\lambda) = \rho \sum_{i=1, n} \frac{u_{i}^{2}} {(d_{i}-\lambda)^{2}}\gt 0 , функция возрастает всюду, кроме точек \lambda = d_{i}. Из этого следует, что корни функции разделяются числами d_{i} и ещё один корень находится справа от точки d_{1} (на рис. 1 d_{1} = 4). (При \rho\lt 0 функция f(\lambda) всюду убывает и соответствующий корень будет находиться слева от точки d_{n}). Для функции f(\lambda), которая является монотонной и гладкой на каждом из интервалов (d_{i+1},d_{i}), можно найти вариант метода Ньютона, который будет быстро и монотонно сходиться к каждому из корней, при условии, что начальная точка взята в (d_{i+1},d_{i}). Нам достаточно знать тот факт, что на практике метод сходится к каждому собственному значению за строго ограниченное число шагов. Поскольку вычисление f(\lambda) и f^{'}(\lambda) стоит O(n) флопов, для вычисления одного собственного значения достаточно O(n) флопов, следовательно для вычисления всех n собственных значений матрицы D + \rho uu^{T} потребуется O(n^{2}) флопов. Для собственных векторов матрицы D + \rho uu^{T} мы легко можем получить явные выражения.

Лемма 2. Если [math]\alpha[/math] - собственное значение матрицы [math]D + \rho uu^{T}[/math], то соответствующий вектор равен [math](D - \alpha I)^{-1}u[/math]. Поскольку матрица [math]D - \alpha I[/math] диагональная, для вычисления такого вектора достаточно [math]O(n)[/math] флопов.

Доказательство:

(D + \rho uu^{T})[(D - \alpha I)^{-1}u] = (D - \alpha I + \alpha I + \rho uu^{T})(D - \alpha I)^{-1}u = u + \alpha (D - \alpha I)^{-1}u + u[\rho u^{T}(D - \alpha I)^{-1}u]=

= u + \alpha(D - \alpha I)^{-1}u - u = \alpha [(D - \alpha I)^{-1}u],

поскольку

\rho u^{T}(D - \alpha I)^{-1}u + 1 = f(\alpha) = 0 .

Что и требовалось доказать.

Получается, что для вычисления по этой простой формуле всех n собственных векторов потребуется O(n^{2}) флопов. К сожалению, данная формула не обеспечивает нам численной устойчивости, так как для двух очень близких значений \alpha_{i} может давать неортогональные приближенные собственные векторы u_{i}. Учёным потребовалось целое десятилетие для того, чтобы найти устойчивую альтернативу исходному описанию алгоритма. Подробнее детали будут обсуждаться ниже в данном разделе.

Дефляция

Если среди всех d_{i} есть совпадающие, а u_{i} не все равны нулю, то вековое уравнение f(\lambda)=0 имеет k вертикальных асимптот, где k\lt n, а потому k корней. Однако оказывается, что остальные n - k собственных значений могут быть определены без каких-либо усилий: если d_{i}=d_{i+1} или u_{i}=0, то легко показать, что d_{i} является собственным значением и для матрицы D + \rho uu^{T}. В такой ситуации мы говорим о дефляции. На практике выбирается некоторое пороговое значение и дефляция для числа d_{i} регистрируется, если в смысле этого порога d_{i} достаточно близко к d_{i+1} либо u_{i} достаточно мало.

1.3 Вычислительное ядро алгоритма

Вычислительным ядром последовательной схемы решения будет являться вычисление матрицы Q собственных векторов при помощи умножения матрицы Q = \begin{bmatrix} Q_{1} & 0 \\ 0 & Q_{2}\end{bmatrix} на матрицу Q^{'}. Эта операция имеет сложность cn^{3} о чём будет говориться ниже, в разделе 1.6 Последовательная сложность алгоритма.

Данной операции предшествует вычисление собственных значений и векторов матрицы D + \rho uu^{T}.

1.4 Макроструктура алгоритма

Алгоритм "разделяй и властвуй" для вычисления собственных значений и векторов симметричной трехдиагональной матрицы состоит из вызова рекурсивной функции proc dc_eig (T, Q, \Lambda), выполнение которой описывается следующими этапами:

- Подаваемая на вход матрица T представляется в виде T = \begin{bmatrix} T_{1} & 0 \\ 0 & T_{2}\end{bmatrix} + b_{m}vv^{T} , представление в таком виде возможно до тех пор, пока размерность матрицы T не достгнет 1.

- От матриц T_{1} и T_{2} также вызываются соотвтетствующие функции proc dc_eig (T_{1}, Q_{1}, \Lambda_{1}) и proc dc_eig (T_{2}, Q_{2}, \Lambda_{2}).

- Вычисляются матрицы D+\rho uu^{T} по \Lambda_{1},\Lambda_{2}, Q_{1}, Q_{2}.

- Вычисление собственных значений\Lambda и векторов Q^{'} для матрицы D+\rho uu^{T}.

- Построение матрицы собственных векторов Qдля матрицы T.

1.5 Схема реализации последовательного алгоритма

Рассмотри реализацию метода "разделяй и властвуй" в виде алгоритма, состоящего из частного случая, когда матрица T имеет размерность 1 \times 1 и общего случая, когда матрица T - симметричная трехдиагональная матрица произвольной размерности, кроме 1 \times 1:

proc dc_eig [math](T, Q, \Lambda) ... [/math] по входной матрице [math]T[/math] вычисляются выходные матрицы [math]Q[/math] и [math]\Lambda[/math], такие, что [math]T = Q\Lambda Q^{T}[/math] if матрица [math]T[/math] имеет размерность [math]1 \times 1[/math] (проверяем матрицу [math]T[/math] на принадлежность частному случаю алгоритма) then присвоить выходным параметрам значения [math]Q = 1, \Lambda = T[/math] (если матрица [math]T[/math] [math]1 \times 1[/math], то СЗ и СВ матрицы [math]T[/math] найдены) else (если матрица [math]T[/math] имеет общей вид, то:) [math]T[/math] в виде [math] T = \begin{bmatrix} T_{1} & 0 \\ 0 & T_{2}\end{bmatrix} + b_{m}vv^{T} [/math] (разложим матрицу [math]T[/math]) call dc_eig[math](T_{1},Q_{1},\Lambda_{1})[/math] (вызываем рекурсивно функцию dc_eig, вычисляющую СЗ и СВ матрицы [math]T_1[/math]) call dc_eig[math](T_{2},Q_{2},\Lambda_{2})[/math] (вызываем рекурсивно функцию dc_eig, вычисляющую СЗ и СВ матрицы [math]T_2[/math]) Построить [math]D+\rho uu^{T}[/math] по [math] \Lambda_{1},\Lambda_{2}, Q_{1}, Q_{2}[/math] Найти матрицу собственных значений [math]\Lambda[/math] Найти матрицу собственных векторов [math]Q^{'}[/math] для матрицы [math]D+\rho uu^{T}[/math] Построить матрицу собственных векторов [math]Q[/math] для матрицы [math]T[/math] : [math] Q = \begin{bmatrix} Q_{1} & 0 \\ 0 & Q_{2}\end{bmatrix}* Q^{'} [/math] Присвоить выходным параметрам значения [math]Q[/math] и [math]\Lambda[/math] endif

1.6 Последовательная сложность алгоритма

Пусть t(n) - число флопов при обработке матрицы размера n \times n процедурой dc_eig. Тогда

t(n) = 2t(n/2) два рекурсивных обращения к dc_eig(T_{i},Q_{i},\Lambda_{i})

+O(n^{2}) вычисление собственных значений матрицы D+\rho uu^{T}

+O(n^{2}) вычисление собственных векторов матрицы D+\rho uu^{T}

+c*n^{3} вычисление матрицы Q = \begin{bmatrix} Q_{1} & 0 \\ 0 & Q_{2}\end{bmatrix}*Q^{'}

Если Q_{1}, Q_{2} и Q^{'} рассматриваются как плотные матрицы и используется стандартный алгоритм матричного умножения, то константа c в последней строке равна 1. Таким образом, именно это умножение составляет наиболее трудоёмкую часть алгоритма в целом. Игнорируя члены порядка n^{2}, получаем t(n) = 2t(n/2) + cn^{3}. Решая это разностное уравнение, находим t \approx c\frac{4}{3}n^{3}

На практике обычно c\lt \lt 1 ( так как матрица Q^{'} весьма разрежена вследствие дефляциии). Дефляция позволяет ускорить процесс умножением матриц. То есть: если u_{i}=0, то соответствующий собственный вектор есть i-й столбец e_{i} единичной матрицы. Это означает, что e_{i} является i-м столбцом в матрице Q_{'}, поэтому при формировании матрицы Q посредством левого умножения Q_{1} на Q_{2} вычисление i-го столбца не требует никаких затрат. Аналогичное упрощение имеет место в случае d_{i} = d_{i+1}. Так как вычисление матрицы Q = \begin{bmatrix} Q_{1} & 0 \\ 0 & Q_{2}\end{bmatrix}*Q^{'} является самым затратным действием, то дефляция многих собственных значений может привести в снижению сложности до O(n^{2}) операций.

1.7 Информационный граф

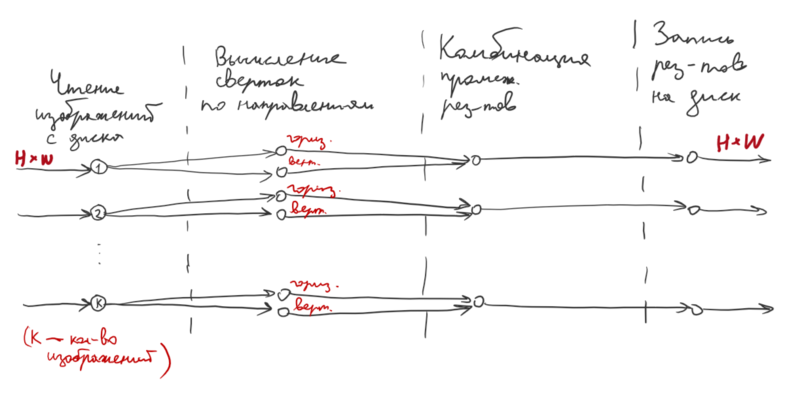

В данном разделе представлен информационный граф алгоритма: на рисунке 2 изображена часть алгоритма, в которой происходит деление - "разделяй", а на рисунке 3 описана часть "властвуй".

Операции:

- D - операция "разделяй" разделения матрицы T на матрицы T_{1} и T_{2}

- C_{n} - операция "властвуй" сбора матрицы D_{n*n}

- R_{n} - операция поиска собственных значений матрицы T_{n*n}

- S^{'}_{n} - операция поиска собственных векторов матрицы D_{n*n}

- S_{n} - операция поиска собственных векторов матрицы T_{n*n}

Данные:

- Q_{n} - вектор собственных значений размерности n.

- V_{n*n} - матрица собственных векторов размерности n.

1.8 Ресурс параллелизма алгоритма

Параллелизм достигается за счёт вызова рекурсивных функций dc_eig, вычисляющих собственные значения и собственные вектора матриц T_1 и T_2. Рекурсивное разделение матрицы приводит к возможности построения структуры в виде двоичного дерева, в каждой вершине которого происходит вычисение функции dc_eig. Таким образом высота ярусно-параллельной формы, где вычисления для каждого листа дерева в такой структуре происходят независимо, составляет log_2(n).

1.9 Входные и выходные данные алгоритма

Входные данные:

Матрица T размерностью n \times n:

- T = \begin{bmatrix} a_{1} & b_{1}&&&&& \\ b_{1} & \ddots & \ddots \\ & \ddots & a_{m-1} & b_{m-1} \\ && b_{m-1} & a_{m} & b_{m} \\ &&& b_{m} & a_{m+1} & b_{m+1} \\ &&&& b_{m+1} & \ddots \\ &&&&&& \ddots & b_{n-1} \\ &&&&&& b_{n-1} & a_{n} \\ \end{bmatrix}

Объем входных данных:

2n-1 - хранить следует только диагональные, поддиагональные и наддиагональные элементы.

Выходные данные:

Собственные значения \alpha_{i} (всего n) и собственные векторы \lambda_{i} (всего n^2).

Объем выходных данных:

n+n^2

1.10 Свойства алгоритма

1. Один из самых быстрых алгоритмов вычисления вектора собственных значений и собственных векторов, соответствующих собственным значениям, матриц порядка большего, чем 25.

2. Вычислительная мощность алгоритма, как отношение числа операций к суммарному объему входных и выходных данных – линейна.

3. Алгоритм не гарантирует высокой относительной точности для малых собственных значений.

2 Программная реализация алгоритма

2.1 Особенности реализации последовательного алгоритма

2.2 Локальность данных и вычислений

2.3 Возможные способы и особенности параллельной реализации алгоритма

2.4 Масштабируемость алгоритма и его реализации

Исследование проводилось на суперкомпьютере "Ломоносов" Суперкомпьютерного комплекса Московского университета.

Для исследования масштабируемости алгоритм был реализован с использованием библиотеки OpenMP 1.5.5 для языка C++(компилятор g++) на cуперкомпьютере Ломоносов на узле compiler. Максимальное число потоков для данного узла равно 8. Для оценки масштабируемости, программа была запущена в 1, 2, 4, 8 потока. Код исследуемой реализации представлен по следующей ссылке

Набор и границы значений изменяемых параметров запуска реализации алгоритма:

- число процессоров [1 : 8] (1,2,3,4,8);

- размер матрицы [4 : 8192].

Параметры компиляции и запуска:

ssh compiler module add slurm module add openmpi/1.5.5-icc g++ GetValues.cxx -fopenmp -std=c++0x -o _scratch/mytask cd _scratch/ sbatch -p test -n1 run ./mytask

Для управления количеством потоков использовалась операция OpenMP omp_set_num_threads();

Проведем оценки масштабируемости:

- По размеру задачи — при увеличении размерности матрицы эффективность реализации постепенно уменьшается. Это связано с тем, что время чтения и подготовки исходных данных растёт быстрее, чем время работы исследуемого алгоритма.

- По числу процессов - при увеличении числа процессов эффективность реализации увеличивается. Это связано с тем, что время чтения и подготовки исходной матрицы остаётся неизменным, а время работы алгоритма уменьшается, однако рост незначительный.

- При одновременном увеличении числа процессов и размерности матрицы эффективность реализации уменьшается.

2.5 Динамические характеристики и эффективность реализации алгоритма

2.6 Выводы для классов архитектур

2.7 Существующие реализации алгоритма

Метод "Разделяй и властвуй" реализован в пакете LAPACK, описание которого можно найти в данной статье.

3 Литература

[1] Джеймс Деммель. Вычислительная линейная алгебра. Теория и приложения. изд. Мир, 1/1/2001. — С. 228 - 236.

[2] Divide-and-conquer eigenvalue algorithm

[3] Gr´egoire Pichon, Azzam Haidar, Mathieu Faverge, Jakub Kurzak. Divide and Conquer Symmetric Tridiagonal Eigensolver for Multicore Architectures. 2015. — С. 1 - 11.

[4] C.F. Borges, W.B. Gragg, A parallel divide-and-conquer method for the generalized real symmetric definite tridiagonal eigenproblem, in: L. Reichel, A. Ruttan, R.S. Varga (Eds.), Numerical Linear Algebra, Proc. Conf. in Numerical Linear Algebra and Scientific Computation, Kent, OH, de Gruyter, Berlin, 1993. — С. 11–29

[5] L. Elsner, A. Fasse, E. Langmann. A divide-and-conquer method for the tridiagonal generalized eigenvalue problem. Journal of Computational and Applied Mathematics. 1997. — С. 141 - 148.